আধুনিক স্বাস্থ্যসেবায় যেভাবে নীরবে বৈষম্য বাড়াচ্ছে কৃত্রিম বুদ্ধিমত্তা

২৮ মার্চ, ২০২৬

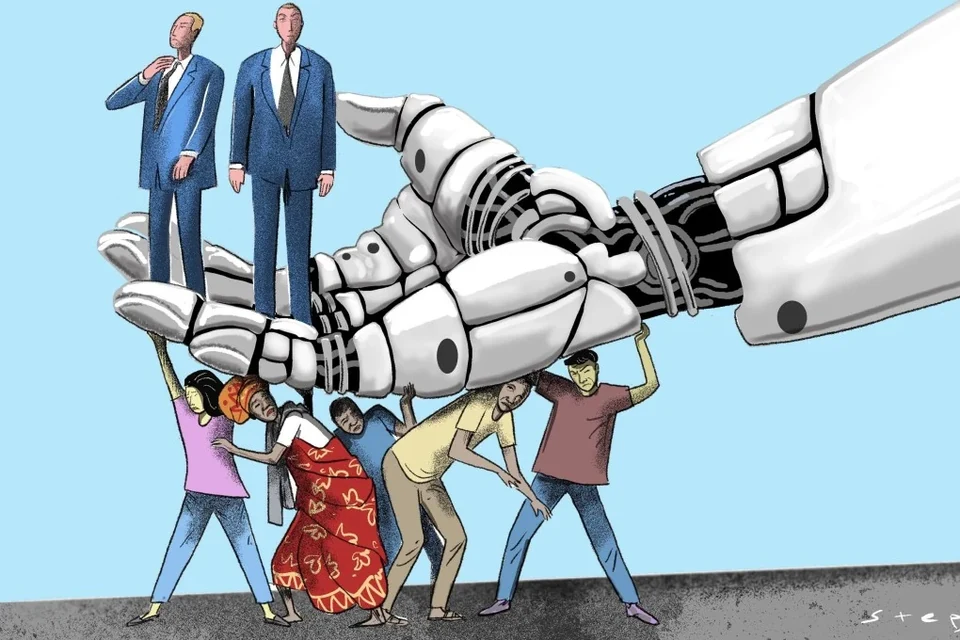

একটি সাধারণ ধারণা প্রচলিত রয়েছে যে, কেবল গণিত আর কোডের ওপর ভিত্তি করে তৈরি কৃত্রিম বুদ্ধিমত্তা সবসময়ই নিরপেক্ষ হয়। মানুষের বিচার বিবেচনা যখন ক্লান্তি, অবচেতন পক্ষপাতিত্ব বা আবেগের কারণে বাধাগ্রস্ত হয়, তখন আমরা ক্রমশ নিরপেক্ষ বিচারক হিসেবে মেশিনের ওপরই ভরসা করছি। স্বাস্থ্যসেবার মতো অত্যন্ত গুরুত্বপূর্ণ ক্ষেত্রে এই কথাটি আরও বেশি সত্যি। রোগ নির্ণয়ের ক্ষেত্রে অ্যালগরিদমকে প্রায়শই মানুষের ত্রুটিপূর্ণ অনুমানের বিপরীতে বিশুদ্ধ ও পক্ষপাতহীন বিজ্ঞানের বিজয় হিসেবে দেখা হয়। তবুও, বিশ্বজুড়ে চিকিৎসাব্যবস্থাগুলো যখন দৈনন্দিন রোগী সেবায় খুব দ্রুত মেশিন লার্নিং বা যন্ত্রের শিক্ষাকে যুক্ত করছে, তখন একটি অত্যন্ত উদ্বেগজনক বাস্তবতা সামনে আসছে। মানুষের পক্ষপাতিত্ব দূর করার বদলে, কৃত্রিম বুদ্ধিমত্তা প্রায়শই সেগুলোকে গ্রহণ করছে, স্বয়ংক্রিয়ভাবে প্রয়োগ করছে এবং বাড়িয়ে তুলছে। এর ফলে ঐতিহাসিক বৈষম্যগুলো একটি অদৃশ্য এবং প্রাতিষ্ঠানিক নিয়মে পরিণত হচ্ছে।

কীভাবে এই সিস্টেমগুলো তৈরি এবং ব্যবহার করা হয়, তা পর্যালোচনা করলেই 'কম্পিউটার পক্ষপাতদুষ্ট হতে পারে না'—এমন ধারণা পুরোপুরি ভেঙে যায়। ২০১৯ সালে 'সায়েন্স' জার্নালে প্রকাশিত একটি যুগান্তকারী গবেষণায় যাচাই-বাছাই ছাড়া অ্যালগরিদমের সিদ্ধান্ত নেওয়ার মারাত্মক বিপদগুলো উঠে এসেছে। যুক্তরাষ্ট্রের স্বাস্থ্যসেবা ব্যবস্থায় বহুল ব্যবহৃত একটি বাণিজ্যিক 'ঝুঁকি-পূর্বাভাস অ্যালগরিদম' নিয়ে গবেষকরা কাজ করেছিলেন। এর কাজ ছিল উচ্চ-ঝুঁকিপূর্ণ সেবা ব্যবস্থাপনা থেকে উপকৃত হতে পারেন এমন রোগীদের শনাক্ত করা। তথ্যে দেখা যায়, অ্যালগরিদমটি ব্যাপকভাবে কৃষ্ণাঙ্গ রোগীদের প্রতি পদ্ধতিগত বৈষম্য করছিল। অ্যালগরিদমের মতে, একজন কৃষ্ণাঙ্গ ও একজন শ্বেতাঙ্গ রোগীর স্বাস্থ্যঝুঁকি যখন হুবহু এক, বাস্তবে তখন কৃষ্ণাঙ্গ রোগীটি তুলনামূলক বেশি অসুস্থ ছিলেন। গণিতের দিক থেকে ত্রুটিপূর্ণ এই স্কোরিংয়ের কারণে, সংখ্যালঘু সম্প্রদায়ের লাখ লাখ রোগী বিশেষজ্ঞ সেবার লাইন থেকে কার্যত ছিটকে পড়েন। ফলে তারা এমন কিছু চিকিৎসা থেকে বঞ্চিত হন, যা হয়তো তাদের জীবন বাঁচাতে বা আয়ু বাড়াতে পারত।

এটি কেবল একটি বিচ্ছিন্ন প্রযুক্তিগত ত্রুটি ছিল না, বরং ডিজিটাল মেডিসিন ক্ষেত্রের অনেক বড় একটি পদ্ধতিগত সমস্যার লক্ষণ ছিল। চর্মরোগ বিদ্যার ক্ষেত্রে, ত্বকের ক্যানসার শনাক্ত করার জন্য তৈরি কৃত্রিম বুদ্ধিমত্তার টুলগুলোকে ঐতিহাসিকভাবে এমন সব ডেটাসেট দিয়ে প্রশিক্ষণ দেওয়া হয়েছে, যেখানে মূলত উজ্জ্বল ত্বকের ছবিই বেশি ছিল। ফলে, বিভিন্ন ধরনের রোগী আসেন এমন বাস্তব ক্লিনিকগুলোতে যখন এই টুলগুলো ব্যবহার করা হয়, তখন গাঢ় রঙের ত্বকের রোগীদের ক্ষেত্রে এর সঠিকতা ব্যাপকভাবে কমে যায়। মেশিন লার্নিং মডেলগুলোকে প্রশিক্ষণ দেওয়ার জন্য ব্যবহৃত উন্মুক্ত চর্মরোগ-বিষয়ক ছবির ডেটাসেটগুলোর একটি বড় পর্যালোচনায় দেখা গেছে, এতে আফ্রিকান, দক্ষিণ এশিয়ান বা হিস্পানিক বংশোদ্ভূত জনগোষ্ঠীর ছবির পরিমাণ খুবই সামান্য। একটি মেশিনকে যা দেখানো হয়, সে ততটুকুই শিখতে পারে। আর যখন প্রাথমিক প্রশিক্ষণের উপকরণগুলো থেকে পুরো একটি নির্দিষ্ট জনগোষ্ঠীকে বাদ দেওয়া হয়, তখন স্বাভাবিকভাবেই তারা এই প্রযুক্তির জীবন রক্ষাকারী সুবিধাগুলো থেকেও বঞ্চিত হয়।

এই ডিজিটাল বৈষম্যের মূল কারণ হিসেবে সফটওয়্যার ইঞ্জিনিয়ারদের ইচ্ছাকৃত বিদ্বেষ খুব কমই দায়ী থাকে। এর বদলে, ঐতিহাসিক ডেটা বা তথ্যকে ভুলভাবে বোঝাই এর প্রধান কারণ। অ্যালগরিদমগুলো বিপুল পরিমাণ পুরোনো তথ্য বিশ্লেষণ করে ভবিষ্যদ্বাণী করতে শেখে এবং সবসময় একই প্যাটার্ন বা ধরন খুঁজতেই থাকে। পক্ষপাতদুষ্ট ওই সেবা-ব্যবস্থাপনা অ্যালগরিদমের ক্ষেত্রে, নির্মাতারা রোগীদের স্বাস্থ্যসেবার প্রয়োজন বুঝতে তাদের অতীতের স্বাস্থ্যখাতের ব্যয়কে মাপকাঠি হিসেবে ব্যবহার করেছিলেন। এর পেছনের ধারণাটি ছিল খুব সহজ এবং যুক্তিসঙ্গত: যেসব রোগীর পেছনে চিকিৎসায় সবচেয়ে বেশি খরচ হয়, তারাই হয়তো সবচেয়ে বেশি অসুস্থ এবং তাদেরই সবচেয়ে বেশি সাহায্য প্রয়োজন। তবে এই ধারণাটি সেই আর্থ-সামাজিক বাস্তবতাকে উপেক্ষা করেছিল যে, প্রান্তিক জনগোষ্ঠী ঐতিহাসিকভাবে চিকিৎসাসেবা পাওয়ার ক্ষেত্রে ব্যাপক বাধার সম্মুখীন হয়েছে। এর মধ্যে নির্ভরযোগ্য বিমার অভাব থেকে শুরু করে চিকিৎসাসুবিধা বর্জিত এলাকায় বসবাসের মতো বিষয়গুলোও রয়েছে। এসব পদ্ধতিগত বাধার কারণে কৃষ্ণাঙ্গ রোগীরা ঐতিহাসিকভাবে স্বাস্থ্যসেবায় কম অর্থ ব্যয় করতেন। আর এই কারণে অ্যালগরিদমটি ভুলভাবে ধরে নিয়েছিল যে তারা জন্মগতভাবেই বেশি সুস্থ এবং ভবিষ্যতে তাদের কম চিকিৎসা প্রয়োজন। কৃত্রিম বুদ্ধিমত্তা প্রেক্ষাপট, বর্ণবাদ বা ইতিহাস বোঝেনি; এটি কেবল তাকে দেওয়া ত্রুটিপূর্ণ সংখ্যাগুলোই বুঝতে পেরেছিল।

অ্যালগরিদমিক পক্ষপাতিত্ব দূর করতে ব্যর্থ হওয়ার পরিণতি অত্যন্ত গুরুতর এবং সুদূরপ্রসারী। যখন এই ধরনের পক্ষপাতদুষ্ট মডেলগুলোকে হাসপাতালের জরুরি বিভাগ (ট্রায়াজ), কিডনি প্রতিস্থাপনের তালিকা বা মাতৃস্বাস্থ্য পর্যবেক্ষণের মতো ব্যবস্থায় নীরবে যুক্ত করা হয়, তখন এর ক্ষতি কর্পোরেট আয়ের ক্ষতির হিসাবে নয়, বরং মানুষের রোগব্যাধি ও মৃত্যুর হার দিয়ে পরিমাপ করা হয়। এটি চিকিৎসা ক্ষেত্রে বৈষম্যের একটি নীরব, স্বয়ংক্রিয় রূপ তৈরি করে, যেখানে ঝুঁকিপূর্ণ জনগোষ্ঠীকে নিয়মিতভাবে আগাম চিকিৎসা বা সঠিক সময়ে রোগ নির্ণয়ের সুবিধা থেকে বঞ্চিত করা হয়। তাছাড়া, এই পরিস্থিতি রোগী এবং চিকিৎসা প্রতিষ্ঠানগুলোর মধ্যকার প্রাথমিক আস্থাকে পুরোপুরি নষ্ট করে দেওয়ার ঝুঁকি তৈরি করে। যদি সাধারণ মানুষ বুঝতে পারে যে, তাদের সেবার মান বাড়ানোর জন্য যে অত্যাধুনিক টুলগুলো ব্যবহার করা হচ্ছে, সেগুলো আসলে তাদের কষ্টের বিষয়ে কাঠামোগতভাবেই অন্ধ, তাহলে জনস্বাস্থ্য উদ্যোগগুলো ব্যাপক সংশয় এবং প্রত্যাখ্যানের সম্মুখীন হবে। এই স্বয়ংক্রিয় পক্ষপাতিত্ব মূলত স্বাস্থ্য খাতের ঐতিহাসিক বৈষম্যগুলোকে স্থায়ী করে দেয় এবং এগুলোকে গাণিতিকভাবে নির্ভুল হিসেবে উপস্থাপন করে। ফলে, ব্যক্তিগত পর্যায়ের চিকিৎসক এবং রোগীদের অধিকার কর্মীদের পক্ষে এগুলোকে চ্যালেঞ্জ করা অবিশ্বাস্যরকম কঠিন হয়ে ওঠে।

এই সংকটের সমাধানের জন্য চিকিৎসা ও প্রযুক্তি উভয় খাতকেই তাদের অ্যালগরিদমিক টুলগুলোর ধারণা, নির্মাণ এবং ব্যবহারের পদ্ধতিতে মৌলিক পরিবর্তন আনতে হবে। স্বাস্থ্যসেবায় কৃত্রিম বুদ্ধিমত্তার ব্যবহার পুরোপুরি বাদ দেওয়া এর সমাধান নয়। কারণ, প্রাথমিক পর্যায়ে টিউমার শনাক্ত করা বা হঠাৎ হৃদরোগের পূর্বাভাস দেওয়ার ক্ষেত্রে এর সম্ভাবনা সত্যিই যুগান্তকারী। এর পরিবর্তে, শিল্প খাতকে অবশ্যই অ্যালগরিদম অডিট করা বা যাচাই করার এবং সবার জন্য অন্তর্ভুক্তিমূলক নকশার একটি কঠোর ও মানসম্মত কাঠামো গ্রহণ করতে হবে। বিশ্ব স্বাস্থ্য সংস্থা এরই মধ্যে স্বাস্থ্য খাতে কৃত্রিম বুদ্ধিমত্তার নৈতিকতা নিয়ে কঠোর নির্দেশিকা জারি করেছে। সেখানে বৈচিত্র্যময় ও প্রতিনিধিত্বমূলক ডেটাসেটের চূড়ান্ত প্রয়োজনীয়তার ওপর জোর দেওয়া হয়েছে। বাস্তব রোগীদের ওপর ব্যবহারের আগে, প্রযুক্তি কোম্পানিগুলোকে তাদের মডেলগুলো যে সব জনগোষ্ঠীর ওপর সমানভাবে কাজ করে, তা প্রমাণ করতে নিয়ন্ত্রক সংস্থাগুলোর বাধ্যবাধকতা থাকা উচিত। সর্বোপরি, যারা এই অ্যালগরিদমগুলো তৈরি করেন, সেই দলে এখন আর শুধু কম্পিউটার বিজ্ঞানী এবং ডেটা ইঞ্জিনিয়ার থাকলে চলবে না। সেখানে অবশ্যই চিকিৎসা নীতিনির্ধারক, সমাজবিজ্ঞানী এবং জনস্বাস্থ্য কর্মীদের অন্তর্ভুক্ত করতে হবে। কারণ, বৈষম্য সৃষ্টি করতে পারে এমন উপাদানগুলো শনাক্ত করার জন্য প্রয়োজনীয় ঐতিহাসিক ও সাংস্কৃতিক জ্ঞান তাদেরই রয়েছে।

কৃত্রিম বুদ্ধিমত্তা কোনো জাদুকরী বা স্বয়ংসম্পূর্ণ বুদ্ধিমত্তা নয়; বরং এটি এমন একটি আয়না, যা ঠিক সেই সমাজকেই প্রতিফলিত করে, যারা এটি তৈরি করেছে। যখন আমরা সেই আয়নাটি আমাদের চিকিৎসা ব্যবস্থার দিকে তাক করি, তখন আমরা সেইসব অস্বস্তিকর এবং গভীরভাবে প্রোথিত বৈষম্যগুলোর মুখোমুখি হতে বাধ্য হই, যা আমরা এখনও সমাধান করতে পারিনি। অ্যালগরিদমিক কোডের অন্তর্নিহিত পক্ষপাতিত্ব দূর করা মূলত মানবসমাজের বৈষম্য দূর করার একটি বৃহত্তর প্রকল্পের সঙ্গে ওতপ্রোতভাবে জড়িত। আমরা যদি আমাদের ত্রুটিপূর্ণ অতীতের ওপর প্রশিক্ষিত 'অন্ধ' অ্যালগরিদমগুলোর ব্যবহার দ্রুত বাড়াতেই থাকি, তবে আমরা কেবল ভবিষ্যতের জন্যই এই বৈষম্যকে স্বয়ংক্রিয় করে তুলব। কিন্তু আমরা যদি প্রাতিষ্ঠানিক স্বচ্ছতা দাবি করি, বৈচিত্র্যময় প্রতিনিধিত্বের ওপর জোর দিই এবং কেবল গাণিতিক দক্ষতার চেয়ে মানবিক প্রেক্ষাপটকে অগ্রাধিকার দিই, তবে আমরা নিশ্চিত করতে পারব যে, ডিজিটাল মেডিসিনের পরবর্তী যুগ জাতি-ধর্ম-বর্ণ নির্বিশেষে প্রতিটি রোগীর স্বাস্থ্য ও মর্যাদার সত্যিকার অর্থে সুরক্ষা দেবে।