आधुनिक स्वास्थ्य सेवा में कैसे आर्टिफिशियल इंटेलिजेंस चुपचाप असमानता को बढ़ावा दे रहा है

28 मार्च 2026

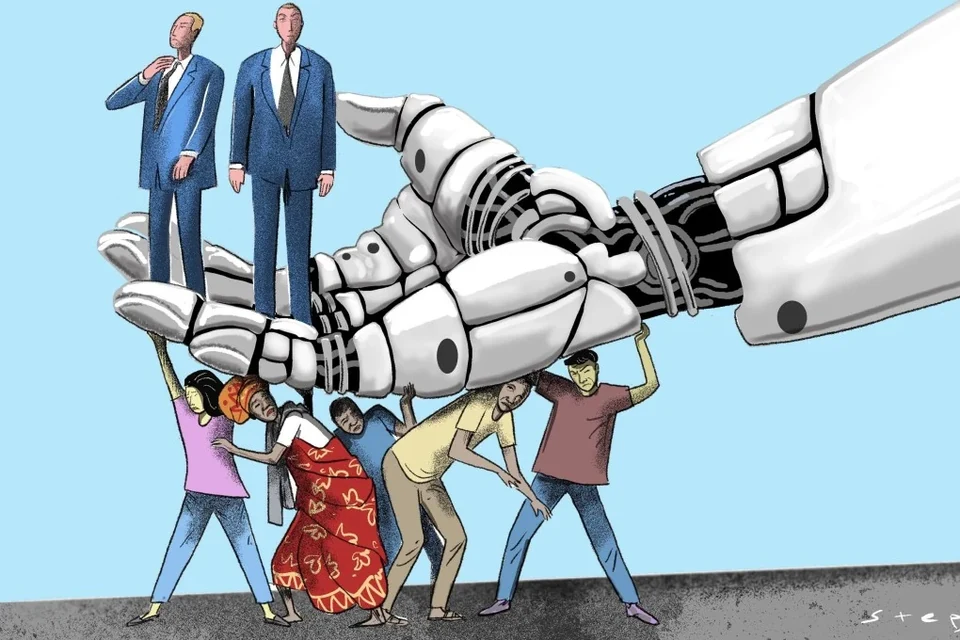

यह एक व्यापक धारणा है कि विशुद्ध गणित और कोड की नींव पर बना आर्टिफिशियल इंटेलिजेंस (AI) स्वाभाविक रूप से निष्पक्ष होता है। जब थकान, अवचेतन पूर्वाग्रह या भावनात्मक सीमाओं के कारण मानवीय फैसले डगमगाते हैं, तो हम तेजी से एक तटस्थ मध्यस्थ के रूप में मशीन की ओर रुख करते हैं। स्वास्थ्य सेवा के अत्यधिक जोखिम वाले क्षेत्र में यह बात विशेष रूप से सच है, जहां रोग-निदान करने वाले एल्गोरिदम को अक्सर दोषपूर्ण मानवीय अंतर्ज्ञान पर शुद्ध और निष्पक्ष विज्ञान की जीत के रूप में पेश किया जाता है। फिर भी, जैसे-जैसे दुनिया भर की चिकित्सा प्रणालियां तेजी से मशीन लर्निंग को मरीजों की रोजमर्रा की देखभाल में शामिल कर रही हैं, एक बेहद परेशान करने वाली वास्तविकता सामने आ रही है। मानवीय पूर्वाग्रह को मिटाने के बजाय, आर्टिफिशियल इंटेलिजेंस अक्सर इसे अपना रहा है, स्वचालित कर रहा है और इसे बढ़ा रहा है, जिससे ऐतिहासिक असमानताएं अदृश्य और संस्थागत नियमों में बदल रही हैं।

यह धारणा कि कंप्यूटर में कोई पूर्वाग्रह नहीं हो सकता, तब पूरी तरह से गलत साबित होती है जब हम देखते हैं कि इन प्रणालियों को वास्तव में कैसे बनाया और लागू किया जाता है। 2019 में 'साइंस' पत्रिका में प्रकाशित एक ऐतिहासिक जांच ने अनियंत्रित एल्गोरिथम निर्णयों के गंभीर खतरों को उजागर किया। शोधकर्ताओं ने अमेरिका की स्वास्थ्य सेवा प्रणाली में व्यापक रूप से उपयोग किए जाने वाले एक कमर्शियल रिस्क-प्रेडिक्शन (जोखिम-अनुमान) एल्गोरिदम की बारीकी से जांच की। इसका उपयोग उन मरीजों की पहचान करने के लिए किया जाता था जिन्हें हाई-रिस्क केयर मैनेजमेंट (उच्च-जोखिम देखभाल प्रबंधन) कार्यक्रमों से लाभ होगा। डेटा से पता चला कि यह एल्गोरिदम बड़े पैमाने पर अश्वेत मरीजों के साथ व्यवस्थित रूप से भेदभाव कर रहा था। यदि एल्गोरिदम ने एक अश्वेत मरीज और एक श्वेत मरीज के स्वास्थ्य जोखिम के स्तर को बिल्कुल समान बताया था, तो वास्तविकता में अश्वेत मरीज कहीं अधिक बीमार था। इस गणितीय रूप से त्रुटिपूर्ण स्कोरिंग के कारण, लाखों अल्पसंख्यक मरीजों को व्यावहारिक रूप से विशेष देखभाल की कतार में पीछे धकेल दिया गया, जिससे वे उन इलाजों से वंचित हो गए जो उनका जीवन बढ़ा सकते थे या उनकी जान बचा सकते थे।

यह कोई अकेली तकनीकी खराबी नहीं थी, बल्कि डिजिटल मेडिसिन में एक बहुत बड़े ढांचागत मुद्दे का लक्षण था। त्वचा विज्ञान (डर्मेटोलॉजी) के क्षेत्र में, त्वचा के कैंसर का पता लगाने के लिए बनाए गए डायग्नोस्टिक एआई टूल्स को ऐतिहासिक रूप से ऐसे डेटासेट पर प्रशिक्षित किया गया है जिनमें मुख्य रूप से हल्के रंग की त्वचा वाली तस्वीरें शामिल थीं। नतीजतन, जब इन डायग्नोस्टिक टूल्स का इस्तेमाल असल जिंदगी के विविध क्लीनिकों में किया जाता है, तो गहरे रंग की त्वचा वाले मरीजों के लिए इनकी सटीकता काफी गिर जाती है। मशीन लर्निंग मॉडल को प्रशिक्षित करने के लिए उपयोग किए जाने वाले ओपन-सोर्स डर्मेटोलॉजिकल इमेज डेटासेट की एक प्रमुख समीक्षा में पाया गया कि तस्वीरों का केवल एक बहुत छोटा हिस्सा अफ्रीकी, दक्षिण एशियाई या हिस्पैनिक मूल की आबादी का प्रतिनिधित्व करता है। मशीन को केवल उतनी ही जानकारी होती है, जितनी दुनिया उसे दिखाई जाती है। ऐसे में जब पूरी की पूरी आबादी को बुनियादी ट्रेनिंग सामग्री से बाहर रखा जाता है, तो वे अनिवार्य रूप से इस तकनीक के जीवन रक्षक लाभों से भी वंचित रह जाते हैं।

इस डिजिटल भेदभाव का मूल कारण शायद ही कभी सॉफ्टवेयर इंजीनियरों की जानबूझकर की गई कोई दुर्भावना होती है, बल्कि यह ऐतिहासिक डेटा की बुनियादी गलतफहमी से पैदा होता है। एल्गोरिदम पुरानी जानकारी की बड़ी मात्रा का विश्लेषण करके और दोहराए जाने वाले पैटर्न खोजकर भविष्यवाणियां करना सीखते हैं। पक्षपाती केयर-मैनेजमेंट एल्गोरिदम के मामले में, डेवलपर्स ने स्वास्थ्य आवश्यकताओं के एक पैमाने (प्रॉक्सी) के रूप में ऐतिहासिक स्वास्थ्य सेवा लागतों का उपयोग करने का विकल्प चुना। यह धारणा सरल और तार्किक लग रही थी: जिन मरीजों पर सबसे अधिक चिकित्सा खर्च की आवश्यकता होती है, वे शायद सबसे ज्यादा बीमार होते हैं और उन्हें सबसे ज्यादा मदद की आवश्यकता होती है। हालांकि, इस धारणा ने इस सामाजिक-आर्थिक वास्तविकता को नजरअंदाज कर दिया कि हाशिए पर रहने वाले समुदायों ने ऐतिहासिक रूप से चिकित्सा देखभाल तक पहुंचने में महत्वपूर्ण बाधाओं का सामना किया है, जिसमें विश्वसनीय बीमा की कमी से लेकर स्वास्थ्य सुविधाओं से वंचित भौगोलिक क्षेत्रों में रहना शामिल है। क्योंकि अश्वेत मरीजों ने ऐतिहासिक रूप से इन प्रणालीगत बाधाओं के कारण स्वास्थ्य सेवा पर कम खर्च किया था, इसलिए एल्गोरिदम ने यह गलत निष्कर्ष निकाला कि वे स्वाभाविक रूप से स्वस्थ हैं और उन्हें भविष्य में कम चिकित्सा मदद की आवश्यकता है। एआई ने संदर्भ, नस्लवाद या इतिहास को नहीं समझा; उसने केवल उन त्रुटिपूर्ण आंकड़ों को समझा जो उसे दिए गए थे।

एल्गोरिथम पूर्वाग्रह को आक्रामकता के साथ दूर करने में विफल रहने के परिणाम गंभीर और दूरगामी हैं। जब पक्षपाती प्रेडिक्टिव (भविष्यवाणी करने वाले) मॉडलों को अस्पतालों के ट्राइएज सिस्टम, किडनी ट्रांसप्लांट (गुर्दा प्रत्यारोपण) रजिस्ट्रियों या मातृ स्वास्थ्य निगरानी में निर्बाध रूप से एकीकृत किया जाता है, तो इसका नुकसान कॉर्पोरेट राजस्व के नुकसान में नहीं, बल्कि मानवीय बीमारी और मृत्यु दर में मापा जाता है। यह 'मेडिकल रेडलाइनिंग' का एक शांत और स्वचालित रूप बनाता है, जहां कमजोर आबादी को नियमित रूप से समय पर इलाज या सटीक निदान से वंचित कर दिया जाता है। इसके अलावा, यह स्थिति मरीजों और चिकित्सा संस्थानों के बीच बुनियादी विश्वास को पूरी तरह से नष्ट करने का खतरा पैदा करती है। यदि समुदायों को यह एहसास हो जाए कि उनकी देखभाल में सुधार के लिए प्रचारित किए जा रहे भविष्य के ये उपकरण वास्तव में उनके दर्द को देखने में ढांचागत रूप से अंधे हैं, तो सार्वजनिक स्वास्थ्य से जुड़ी पहलों को संदेह और इनकार की बड़ी दीवारों का सामना करना पड़ेगा। पूर्वाग्रह का स्वचालन (ऑटोमेशन) अनिवार्य रूप से ऐतिहासिक स्वास्थ्य असमानताओं को स्थायी बना देता है, जिससे उन्हें गणितीय अनिवार्यता का एक ऐसा आवरण मिल जाता है जिसे व्यक्तिगत डॉक्टरों और मरीज अधिकार कार्यकर्ताओं के लिए चुनौती देना अविश्वसनीय रूप से कठिन हो जाता है।

इस संकट को सुधारने के लिए चिकित्सा और प्रौद्योगिकी दोनों क्षेत्रों को एल्गोरिथम उपकरणों की कल्पना, निर्माण और तैनाती के तरीके में बुनियादी बदलाव करने की आवश्यकता है। इसका समाधान स्वास्थ्य सेवा में आर्टिफिशियल इंटेलिजेंस को पूरी तरह से छोड़ देना नहीं है, क्योंकि शुरुआती चरण के ट्यूमर को पकड़ने या अचानक होने वाली हृदय संबंधी घटनाओं की भविष्यवाणी करने की इसकी क्षमता वास्तव में क्रांतिकारी है। इसके बजाय, उद्योग को एल्गोरिथम ऑडिटिंग और समावेशी डिजाइन के लिए कठोर, मानकीकृत ढांचे अपनाने चाहिए। विश्व स्वास्थ्य संगठन (WHO) ने पहले ही स्वास्थ्य में आर्टिफिशियल इंटेलिजेंस की नैतिकता पर कड़े दिशा-निर्देश जारी किए हैं, जो विविध और सभी का प्रतिनिधित्व करने वाले डेटासेट की पूर्ण आवश्यकता पर जोर देते हैं। प्रौद्योगिकी कंपनियों को नियामक निकायों द्वारा यह साबित करने के लिए अनिवार्य किया जाना चाहिए कि उनके मॉडल अलग-अलग जनसांख्यिकीय समूहों में समान रूप से अच्छा प्रदर्शन करते हैं, और यह साबित होने के बाद ही इन उपकरणों को असली मरीजों के साथ उपयोग करने की अनुमति दी जाए। इसके अलावा, इन एल्गोरिदम को डिजाइन करने वाली टीमों में अब केवल कंप्यूटर वैज्ञानिक और डेटा इंजीनियर शामिल नहीं हो सकते। उनमें चिकित्सा नीतिशास्त्री, समाजशास्त्री और सामुदायिक स्वास्थ्य कार्यकर्ता भी शामिल होने चाहिए, जिनके पास ऐतिहासिक और सांस्कृतिक संदर्भ हो, जो उन प्रॉक्सी चरों (वैरिएबल्स) को पहचान सकें जो भेदभाव का कारण बनते हैं।

आर्टिफिशियल इंटेलिजेंस कोई जादुई, स्वतंत्र बुद्धि नहीं है; यह एक ऐसा गहरा दर्पण है जो उसी समाज को दर्शाता है जिसने इसे बनाया है। जब हम उस दर्पण को अपनी चिकित्सा प्रणालियों की ओर मोड़ते हैं, तो हमें उन असहज और गहराई तक जमी हुई असमानताओं का सामना करने के लिए मजबूर होना पड़ता है जिन्हें हम अब तक सुलझाने में विफल रहे हैं। एल्गोरिथम कोड के भीतर अंतर्निहित पूर्वाग्रहों को ठीक करना, अंततः मानव समाज में असमानताओं को दूर करने की बहुत बड़ी परियोजना से जुड़ा हुआ है। यदि हम एक त्रुटिपूर्ण अतीत पर प्रशिक्षित अंधे एल्गोरिदम को तेजी से लागू करना जारी रखते हैं, तो हम बस भविष्य के लिए असमानता को स्वचालित कर देंगे। लेकिन अगर हम संस्थागत पारदर्शिता की मांग करते हैं, विविध प्रतिनिधित्व पर जोर देते हैं, और कच्चे गणितीय कौशल के बजाय मानवीय संदर्भ को प्राथमिकता देते हैं, तो हम यह सुनिश्चित कर सकते हैं कि डिजिटल मेडिसिन का अगला युग वास्तव में हर मरीज के स्वास्थ्य और सम्मान की सेवा करे, चाहे उनकी पृष्ठभूमि कुछ भी हो।