Trí tuệ nhân tạo đang âm thầm tự động hóa sự bất bình đẳng trong y tế hiện đại như thế nào

28 tháng 3, 2026

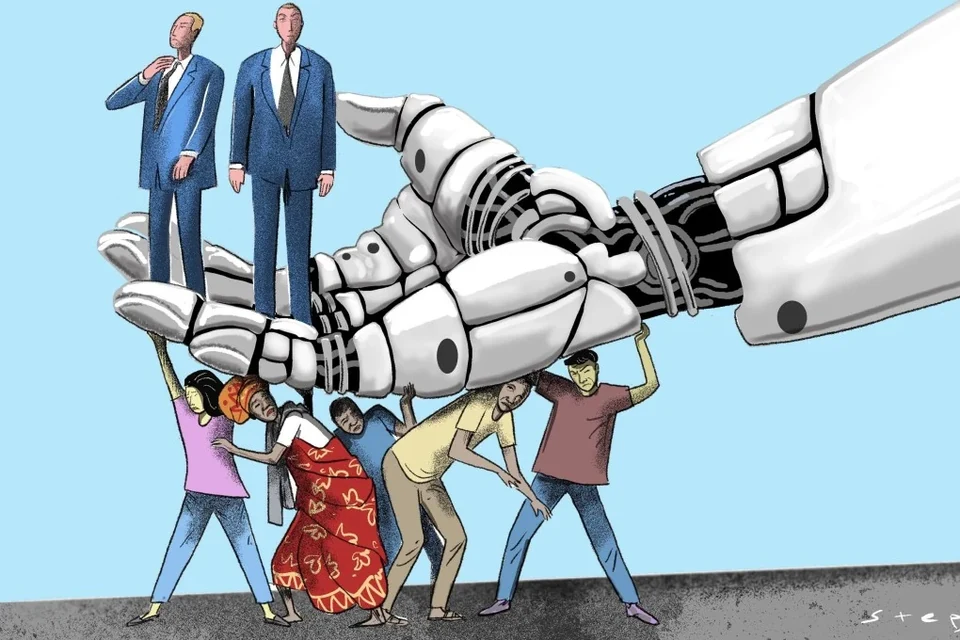

Có một quan niệm phổ biến rằng trí tuệ nhân tạo, vốn được xây dựng trên nền tảng toán học và mã lệnh thuần túy, mang bản chất khách quan. Khi phán đoán của con người sai lệch do mệt mỏi, định kiến vô thức hay những điểm mù về cảm xúc, chúng ta ngày càng tìm đến máy móc như một trọng tài trung lập. Điều này đặc biệt đúng trong lĩnh vực y tế mang tính sống còn, nơi tiềm năng của các thuật toán chẩn đoán thường được xem là chiến thắng của khoa học thuần túy, không thiên vị trước trực giác đầy thiếu sót của con người. Tuy nhiên, khi các hệ thống y tế trên toàn thế giới nhanh chóng đưa học máy vào việc chăm sóc bệnh nhân hàng ngày, một thực tế vô cùng đáng lo ngại đang hiện ra. Thay vì xóa bỏ định kiến của con người, trí tuệ nhân tạo thường lại tiếp thu, tự động hóa và khuếch đại chúng, biến những bất bình đẳng trong lịch sử thành những quy tắc vô hình, ăn sâu vào hệ thống.

Quan điểm cho rằng máy tính không có định kiến sẽ hoàn toàn sụp đổ khi xem xét cách thức các hệ thống này thực sự được xây dựng và triển khai. Một cuộc điều tra mang tính bước ngoặt được công bố trên tạp chí Science vào năm 2019 đã phơi bày những nguy hiểm sâu sắc của việc ra quyết định bằng thuật toán mà không được kiểm soát. Các nhà nghiên cứu đã xem xét kỹ lưỡng một thuật toán dự đoán rủi ro thương mại được sử dụng rộng rãi trên toàn hệ thống y tế Mỹ nhằm xác định những bệnh nhân cần đến các chương trình quản lý chăm sóc nguy cơ cao. Dữ liệu cho thấy thuật toán này đã phân biệt đối xử có hệ thống đối với các bệnh nhân da đen trên quy mô lớn. Đối với một bệnh nhân da đen và một bệnh nhân da trắng được thuật toán xác định là có cùng mức độ rủi ro sức khỏe, thì trên thực tế, bệnh nhân da đen lại bệnh nặng hơn đáng kể. Do cách chấm điểm có sai sót về mặt toán học này, hàng triệu bệnh nhân thuộc nhóm thiểu số thực chất đã bị đẩy lùi về phía sau trong hàng đợi chăm sóc chuyên khoa, bị tước đi những biện pháp can thiệp có thể kéo dài hoặc cứu sống mạng sống của họ.

Đây không phải là một lỗi kỹ thuật đơn lẻ, mà đúng hơn là triệu chứng của một vấn đề mang tính hệ thống rộng lớn hơn nhiều trong nền y học kỹ thuật số. Trong lĩnh vực da liễu, các công cụ chẩn đoán bằng trí tuệ nhân tạo được thiết kế để phát hiện ung thư da từ trước đến nay chủ yếu được huấn luyện trên các tập dữ liệu với phần lớn là hình ảnh của những làn da sáng màu. Hậu quả là, khi các công cụ chẩn đoán này được đưa vào sử dụng thực tế tại các phòng khám đa dạng, độ chính xác của chúng sụt giảm nghiêm trọng đối với những bệnh nhân có làn da sẫm màu. Một đánh giá lớn về các tập dữ liệu hình ảnh da liễu nguồn mở được dùng để huấn luyện các mô hình học máy cho thấy chỉ có một tỷ lệ cực kỳ nhỏ hình ảnh đại diện cho các nhóm người gốc Phi, Nam Á hoặc gốc Tây Ban Nha. Máy móc chỉ hiểu biết đến mức giới hạn của thế giới mà nó được cho xem, và khi toàn bộ các nhóm nhân khẩu học bị bỏ sót khỏi tài liệu huấn luyện nền tảng, họ chắc chắn sẽ bị gạt ra khỏi những lợi ích cứu mạng của công nghệ này.

Nguyên nhân sâu xa của sự phân biệt đối xử kỹ thuật số này hiếm khi xuất phát từ ác ý có chủ đích của các kỹ sư phần mềm, mà bắt nguồn từ sự hiểu lầm cơ bản về dữ liệu lịch sử. Các thuật toán học cách đưa ra dự đoán bằng cách phân tích một lượng lớn thông tin trong quá khứ, liên tục tìm kiếm các quy luật để sao chép. Trong trường hợp của thuật toán quản lý chăm sóc bị thiên lệch, các nhà phát triển đã chọn sử dụng chi phí y tế trong quá khứ làm thước đo cho nhu cầu sức khỏe. Giả định này rất đơn giản và có vẻ hợp lý: những bệnh nhân tiêu tốn nhiều chi phí y tế nhất có khả năng là những người bệnh nặng nhất và cần được giúp đỡ nhiều nhất. Tuy nhiên, giả định này đã bỏ qua thực tế kinh tế xã hội rằng các cộng đồng yếu thế trong lịch sử từng phải đối mặt với những rào cản lớn trong việc tiếp cận dịch vụ y tế, từ việc thiếu bảo hiểm đáng tin cậy cho đến việc sống ở những vùng thiếu thốn tiện nghi y tế. Do bệnh nhân da đen trong quá khứ chi tiêu ít hơn cho y tế vì những rào cản hệ thống này, thuật toán đã kết luận sai lầm rằng họ vốn dĩ khỏe mạnh hơn và ít cần can thiệp hơn trong tương lai. Trí tuệ nhân tạo không hiểu được bối cảnh, chủ nghĩa phân biệt chủng tộc hay lịch sử; nó chỉ hiểu những con số nhiều thiếu sót mà nó được nạp vào.

Hậu quả của việc không giải quyết triệt để sự thiên lệch trong thuật toán là vô cùng nghiêm trọng và sâu rộng. Khi các mô hình dự đoán bị thiên lệch được tích hợp một cách trơn tru vào hệ thống phân loại bệnh nhân của bệnh viện, danh sách đăng ký ghép thận hoặc hệ thống theo dõi sức khỏe thai sản, thiệt hại không được đo bằng doanh thu doanh nghiệp bị mất, mà bằng tỷ lệ mắc bệnh và tử vong của con người. Điều này tạo ra một hình thức khoanh vùng phân biệt đối xử y tế âm thầm, tự động, nơi các nhóm dân cư dễ bị tổn thương thường xuyên bị từ chối các phương pháp điều trị chủ động hoặc chẩn đoán kịp thời. Hơn nữa, thực trạng này đe dọa bào mòn hoàn toàn niềm tin nền tảng giữa bệnh nhân và các cơ sở y tế. Nếu cộng đồng nhận ra rằng những công cụ của tương lai, vốn được quảng bá là để cải thiện việc chăm sóc sức khỏe cho họ, thực chất lại hoàn toàn mù quáng trước nỗi đau của họ do lỗi hệ thống, thì các sáng kiến y tế cộng đồng sẽ phải đối mặt với những bức tường nghi ngờ và từ chối không thể vượt qua. Việc tự động hóa định kiến về cơ bản đã khóa chặt những chênh lệch sức khỏe trong lịch sử, khoác lên chúng một lớp vỏ bọc về tính tất yếu của toán học, khiến cho các bác sĩ và những người bênh vực bệnh nhân vô cùng khó khăn để thách thức lại điều đó.

Việc khắc phục cuộc khủng hoảng này đòi hỏi một sự thay đổi cơ bản trong cách thức mà cả lĩnh vực y tế và công nghệ hình thành ý tưởng, xây dựng và triển khai các công cụ thuật toán. Giải pháp không đơn thuần là từ bỏ trí tuệ nhân tạo trong y tế, bởi tiềm năng của nó trong việc phát hiện các khối u ở giai đoạn đầu hay dự đoán các cơn đau tim đột ngột vẫn thực sự mang tính cách mạng. Thay vào đó, ngành công nghiệp này phải áp dụng các bộ khung tiêu chuẩn, nghiêm ngặt để kiểm toán thuật toán và thiết kế mang tính bao trùm. Tổ chức Y tế Thế giới (WHO) đã ban hành những hướng dẫn khắt khe về đạo đức của trí tuệ nhân tạo trong y tế, nhấn mạnh tính cần thiết tuyệt đối của các tập dữ liệu đa dạng và mang tính đại diện. Các công ty công nghệ phải bị các cơ quan quản lý bắt buộc chứng minh rằng mô hình của họ hoạt động tốt như nhau trên các nhóm nhân khẩu học khác nhau trước khi những công cụ đó được phép tiếp xúc với bệnh nhân thực tế. Hơn nữa, đội ngũ thiết kế các thuật toán này không thể chỉ bao gồm các nhà khoa học máy tính và kỹ sư dữ liệu. Họ phải bao gồm cả các nhà đạo đức học y khoa, các nhà xã hội học và những người ủng hộ y tế cộng đồng, những người nắm giữ bối cảnh lịch sử và văn hóa cần thiết để phát hiện ra các biến đại diện dẫn đến sự phân biệt đối xử.

Trí tuệ nhân tạo không phải là một trí óc độc lập, đầy phép màu; nó là một tấm gương chân thực phản chiếu chính xác xã hội đã tạo ra nó. Khi chúng ta hướng tấm gương đó vào các hệ thống y tế của mình, chúng ta buộc phải đối mặt với những sự chênh lệch khó chịu, ăn sâu bén rễ mà cho đến nay chúng ta vẫn chưa thể giải quyết. Việc chữa lành những định kiến cố hữu bên trong mã thuật toán rốt cuộc lại đan xen chặt chẽ với một dự án lớn hơn nhiều: đó là chữa lành những bất công trong xã hội loài người. Nếu chúng ta tiếp tục nhanh chóng triển khai các thuật toán mù quáng được đào tạo từ một quá khứ đầy sai lầm, chúng ta sẽ chỉ đơn giản là tự động hóa sự bất bình đẳng cho tương lai. Nhưng nếu chúng ta đòi hỏi sự minh bạch từ các tổ chức, kiên quyết yêu cầu sự đại diện đa dạng và đặt bối cảnh con người lên trên sự hiệu quả toán học thô cứng, chúng ta có thể đảm bảo rằng kỷ nguyên tiếp theo của nền y học kỹ thuật số sẽ thực sự phục vụ sức khỏe và phẩm giá của mọi bệnh nhân, bất kể xuất thân của họ là gì.