Comment l'intelligence artificielle automatise discrètement les inégalités dans la médecine moderne

28 mars 2026

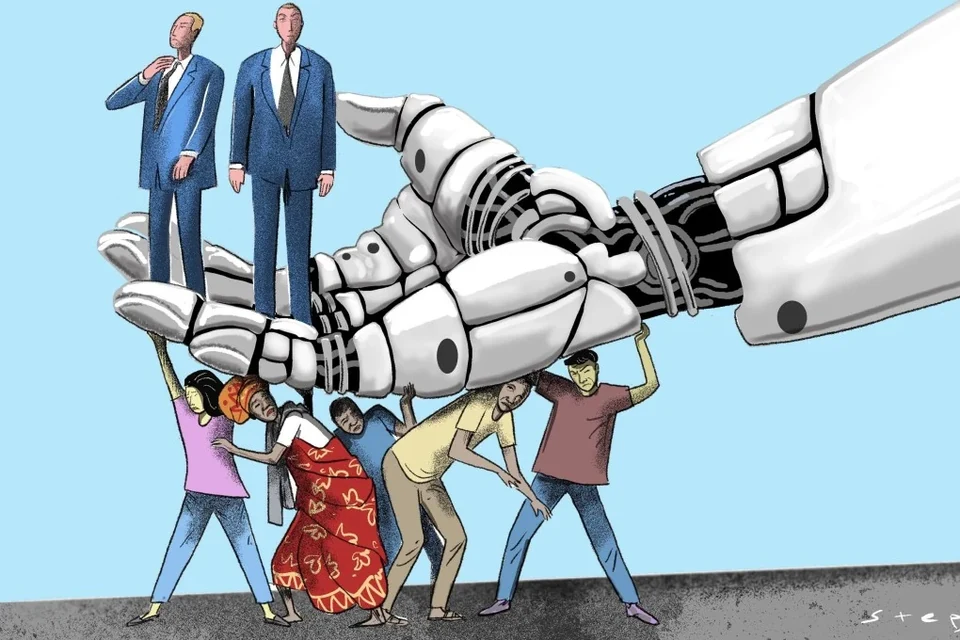

On part souvent du principe que l'intelligence artificielle, fondée sur des mathématiques brutes et du code, est intrinsèquement objective. Lorsque le jugement humain vacille, obscurci par l'épuisement, les préjugés inconscients ou les angles morts émotionnels, nous nous tournons de plus en plus vers la machine comme un arbitre neutre. C'est particulièrement vrai dans le domaine crucial de la santé, où la promesse des algorithmes de diagnostic est souvent présentée comme le triomphe d'une science pure et impartiale sur une intuition humaine imparfaite. Pourtant, alors que les systèmes médicaux du monde entier intègrent rapidement l'apprentissage automatique dans les soins quotidiens aux patients, une réalité profondément inquiétante émerge. Au lieu d'effacer les préjugés humains, l'intelligence artificielle les absorbe, les automatise et les amplifie souvent, transformant les inégalités historiques en règles invisibles et institutionnalisées.

L'idée qu'un ordinateur ne peut pas avoir de préjugés s'effondre complètement lorsque l'on examine comment ces systèmes sont réellement conçus et déployés. Une enquête de référence publiée dans la revue Science en 2019 a révélé les dangers profonds de la prise de décision algorithmique non contrôlée. Les chercheurs ont examiné de près un algorithme commercial de prédiction des risques, largement utilisé dans le système de santé des États-Unis pour identifier les patients susceptibles de bénéficier de programmes de gestion des soins à haut risque. Les données ont montré que l'algorithme discriminait systématiquement les patients noirs à grande échelle. Pour un patient noir et un patient blanc que l'algorithme évaluait au même niveau de risque pour leur santé, le patient noir était, en réalité, nettement plus malade. À cause de cette évaluation mathématiquement faussée, des millions de patients issus de minorités ont été concrètement repoussés plus loin dans la file d'attente pour des soins spécialisés, privés d'interventions qui auraient pu prolonger ou sauver leur vie.

Il ne s'agissait pas d'un bug technologique isolé, mais plutôt du symptôme d'un problème systémique beaucoup plus vaste dans la médecine numérique. Dans le domaine de la dermatologie, les outils de diagnostic par intelligence artificielle conçus pour détecter les cancers de la peau ont historiquement été entraînés sur des bases de données composées en très grande majorité d'images montrant des peaux claires. Par conséquent, lorsque ces outils de diagnostic sont déployés dans diverses cliniques du monde réel, leur précision s'effondre pour les patients à la peau plus foncée. Une étude majeure portant sur les bases de données d'images dermatologiques en libre accès, utilisées pour entraîner les modèles d'apprentissage automatique, a révélé qu'une fraction seulement microscopique de ces images représentait des populations d'origine africaine, sud-asiatique ou hispanique. La machine n'est experte que du monde qu'on lui montre, et lorsque des pans entiers de la population sont exclus des données d'entraînement de base, ils sont inévitablement exclus des bénéfices vitaux de cette technologie.

La cause sous-jacente de cette discrimination numérique découle rarement d'une malveillance délibérée de la part des ingénieurs en logiciels, mais plutôt d'une mauvaise compréhension fondamentale des données historiques. Les algorithmes apprennent à faire des prédictions en analysant de vastes quantités d'informations passées, à la recherche constante de schémas à reproduire. Dans le cas de l'algorithme biaisé de gestion des soins, les développeurs ont choisi d'utiliser l'historique des coûts de santé comme indicateur des besoins médicaux. L'hypothèse était simple et semblait logique : les patients qui nécessitent le plus de dépenses médicales sont probablement les plus malades et ont le plus besoin d'aide. Cependant, cette hypothèse ignorait la réalité socio-économique voulant que les communautés marginalisées aient historiquement fait face à d'importants obstacles pour accéder aux soins médicaux, allant du manque d'assurance fiable à la vie dans des déserts médicaux géographiques. Étant donné que les patients noirs dépensaient historiquement moins en soins de santé en raison de ces obstacles systémiques, l'algorithme a faussement conclu qu'ils étaient intrinsèquement en meilleure santé et nécessitaient moins d'interventions à l'avenir. L'intelligence artificielle ne comprenait ni le contexte, ni le racisme, ni l'histoire ; elle ne comprenait que les chiffres biaisés qu'on lui fournissait.

Les conséquences d'un manque d'action forte contre les biais algorithmiques sont graves et profondes. Lorsque des modèles prédictifs biaisés sont intégrés de manière transparente dans les systèmes de triage des hôpitaux, les registres de transplantation rénale ou le suivi de la santé maternelle, les dégâts ne se mesurent pas en pertes de revenus pour les entreprises, mais en morbidité et mortalité humaines. Cela crée une forme silencieuse et automatisée de ségrégation médicale, où les populations vulnérables se voient régulièrement refuser des traitements proactifs ou des diagnostics formulés au bon moment. De plus, cette dynamique menace de détruire complètement la confiance fondamentale entre les patients et les institutions médicales. Si les communautés réalisent que les outils futuristes censés améliorer leurs soins sont en fait structurellement aveugles à leur souffrance, les initiatives de santé publique se heurteront à des murs insurmontables de scepticisme et de refus. L'automatisation des préjugés fige essentiellement les disparités de santé historiques, leur donnant un vernis d'inévitabilité mathématique qui les rend incroyablement difficiles à contester pour les médecins et les défenseurs des patients.

Corriger cette crise nécessite un changement fondamental dans la façon dont les secteurs médical et technologique conçoivent, construisent et déploient les outils algorithmiques. La solution n'est pas d'abandonner purement et simplement l'intelligence artificielle dans le domaine de la santé, car son potentiel pour détecter des tumeurs à un stade précoce ou prédire des accidents cardiaques soudains reste véritablement révolutionnaire. Au lieu de cela, l'industrie doit adopter des cadres rigoureux et standardisés pour l'audit des algorithmes et la conception inclusive. L'Organisation mondiale de la Santé a déjà publié des directives strictes sur l'éthique de l'intelligence artificielle dans la santé, soulignant la nécessité absolue de disposer de jeux de données diversifiés et représentatifs. Les entreprises technologiques doivent être contraintes par les organismes de réglementation de prouver que leurs modèles sont tout aussi performants dans différents groupes démographiques avant même que ces outils ne soient autorisés à interagir avec de vrais patients. En outre, les équipes concevant ces algorithmes ne peuvent plus être composées uniquement d'informaticiens et d'ingénieurs en données. Elles doivent inclure des spécialistes de l'éthique médicale, des sociologues et des acteurs de la santé communautaire qui possèdent le contexte historique et culturel nécessaire pour repérer les variables indirectes qui mènent à la discrimination.

L'intelligence artificielle n'est pas un intellect magique et autonome ; c'est un miroir profond qui reflète exactement la société qui l'a créée. Lorsque nous braquons ce miroir sur nos systèmes médicaux, nous sommes forcés d'affronter les disparités inconfortables et profondément enracinées que nous n'avons pas réussi à résoudre jusqu'à présent. Guérir les préjugés inhérents au code algorithmique est en fin de compte lié au projet beaucoup plus vaste de guérir les inégalités de la société humaine. Si nous continuons à déployer rapidement des algorithmes aveugles, formés sur un passé défaillant, nous ne ferons qu'automatiser les inégalités de demain. Mais si nous exigeons la transparence institutionnelle, insistons sur une représentation diversifiée et privilégions le contexte humain à l'efficacité mathématique brute, nous pouvons garantir que la prochaine ère de la médecine numérique servira véritablement la santé et la dignité de chaque patient, quelles que soient ses origines.