Ces puces minuscules qui vont révolutionner l'accès à l'IA

1 avril 2026

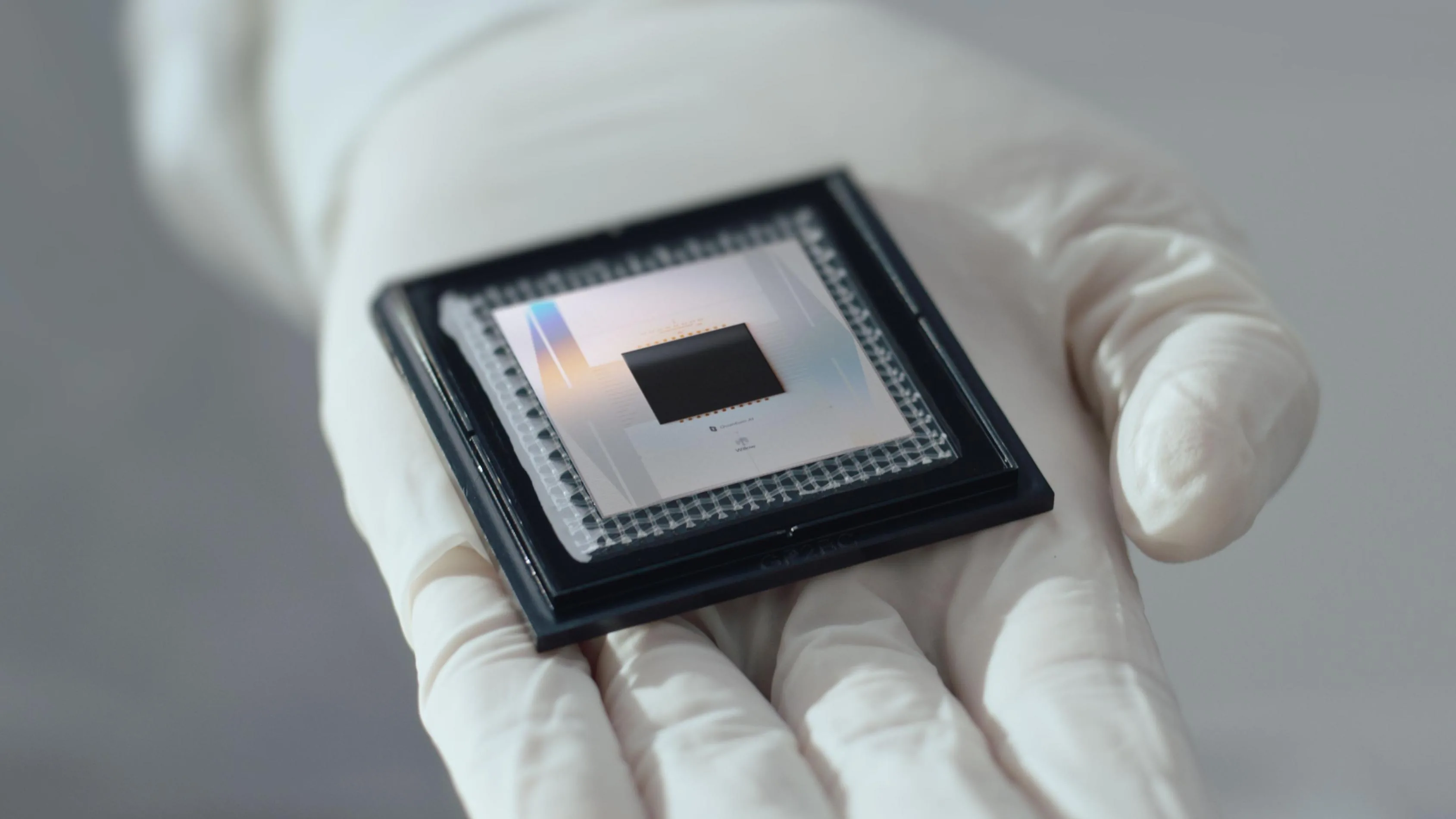

Beaucoup de gens imaginent encore l'intelligence artificielle enfermée dans d'immenses data centers. On la voit comme une technologie très gourmande en électricité et contrôlée par quelques géants mondiaux. Cette image est en partie vraie. L'entraînement des plus grands modèles demande une puissance de calcul colossale. Mais une toute nouvelle invention remet ce schéma en question. Il s'agit de minuscules puces "Edge AI" (l'IA en périphérie). Elles sont conçues pour faire tourner des tâches complexes directement sur de petits appareils. Ce changement semble technique. En réalité, il va transformer notre façon d'utiliser des ordinateurs puissants. Il va aussi modifier le trajet de nos données et rendre notre quotidien beaucoup moins dépendant du cloud.

Le fait le plus important est simple. Envoyer des données vers des serveurs lointains est souvent lent, cher et très gourmand en énergie. Cela crée aussi des risques pour la vie privée. C'est un problème, car notre vie moderne dépend de plus en plus d'appareils connectés. Nos téléphones écoutent nos commandes vocales. Les voitures surveillent la route et les piétons. Dans les usines, des capteurs traquent les pannes. Les appareils médicaux analysent la parole, les mouvements et le rythme cardiaque. Si chaque action dépend d'un serveur distant, une mauvaise connexion internet bloque tout. Les coûts augmentent, et les délais aussi.

C'est pourquoi les fabricants ont fait la course ces dernières années. Leur but est de ramener la puissance de calcul directement dans l'appareil. Ce n'est plus une simple expérience de niche. Apple a intégré des "moteurs neuronaux" dans ses téléphones et ses ordinateurs. Qualcomm vend des puces prêtes pour l'IA sur mobile. Nvidia, Arm et Intel se disputent tous ce marché de l'edge computing. Les startups vont encore plus loin. Elles créent des puces ultra-spécialisées. Ces puces accomplissent des tâches d'IA très précises en utilisant une fraction seulement de l'énergie des processeurs classiques. Depuis des années, les analystes de Gartner voient l'Edge AI comme une tendance technologique majeure. Les prévisions du secteur annoncent une croissance rapide des dépenses. Les entreprises veulent en effet traiter les données au plus près de leur source.

La grande nouveauté n'est pas seulement la vitesse des puces. C'est surtout leur incroyable efficacité dans des formats minuscules. Des chercheurs développent des architectures neuromorphiques et des calculs "en mémoire". Ces systèmes réduisent le besoin de déplacer les données entre la mémoire et le processeur. C'est une vraie avancée, car ce déplacement consomme énormément d'énergie. IBM, Intel et plusieurs startups ont publié des résultats étonnants. Leurs modèles, inspirés du cerveau humain ou centrés sur la mémoire, réduisent drastiquement l'énergie consommée. Ils sont parfaits pour reconnaître des formes ou analyser des capteurs. Ce domaine est encore jeune. De nombreux prototypes ne sont pas prêts pour le grand public. Mais la direction est claire. L'IA n'est plus obligée d'être une machine brûlante et coûteuse, reliée à une ferme de serveurs géante.

La cause profonde de ce changement est une vraie limite physique et économique. Pendant des années, l'industrie a amélioré les performances en réduisant la taille des puces pour y entasser plus de transistors. Cela continue, mais les progrès sont de plus en plus difficiles et chers. En même temps, les besoins de l'IA ont explosé. L'Agence internationale de l'énergie a lancé un avertissement. Les data centers, surtout ceux liés à l'IA, consomment désormais énormément d'électricité. La solution n'est pas toujours de construire des centres encore plus grands. Bien souvent, il est plus intelligent d'éviter d'y envoyer autant de données. Une montre connectée peut détecter une chute. Un capteur agricole peut repérer qu'une plante manque d'eau. Un appareil auditif peut nettoyer le son d'une voix en temps réel sans accès au cloud. Dans ces cas-là, le traitement local n'est plus un simple confort. Il devient une vraie nécessité de conception.

On voit déjà les effets concrets de ce changement. Dans la santé, des chercheurs ont testé des outils d'Edge AI capables de signaler des anomalies cardiaques ou de suivre la respiration. Ces appareils n'ont pas besoin d'envoyer toutes les données brutes sur un serveur. C'est très important dans les zones rurales où la connexion internet est mauvaise. La FCC américaine (Federal Communications Commission) dénonce d'ailleurs régulièrement le manque d'accès au haut débit dans les régions isolées. Dans l'industrie, des systèmes d'IA locaux inspectent les pièces sur les chaînes de montage en quelques millisecondes. Cela réduit les déchets et les temps d'arrêt. Dans les voitures, la vitesse est vitale. Un véhicule ne peut pas attendre la réponse d'un serveur distant pour savoir si un objet sur la route est un enfant, un vélo ou un sac plastique.

L'argument de la vie privée est tout aussi fort. Beaucoup de consommateurs s'inquiètent des appareils qui enregistrent constamment leurs voix, leurs vidéos ou leurs données de santé. Les récents piratages rendent cette peur tout à fait logique. Les rapports annuels d'IBM le prouvent. Les vols de données personnelles coûtent très cher aux entreprises et font beaucoup de tort aux utilisateurs. Quand l'analyse se fait directement sur l'appareil, beaucoup moins de données sensibles doivent en sortir. Cela ne règle pas tous les problèmes de vie privée. Des logiciels mal faits ou des pratiques douteuses peuvent toujours exposer les utilisateurs. Mais faire les calculs localement permet de réduire la quantité d'informations personnelles qui circulent dans les serveurs des entreprises.

Il y a aussi un enjeu d'accès à l'échelle mondiale. Le cloud dépend de solides infrastructures, d'immenses flottes de serveurs et de systèmes de paiement fiables. Ce modèle favorise souvent les pays et les entreprises riches. Des puces d'IA plus petites et moins chères pourraient faire tomber cette barrière. En Inde, en Afrique et en Amérique latine, les téléphones portables sont très répandus. Mais le haut débit fixe reste parfois limité ou cher. Une IA locale sur des téléphones bon marché pourrait offrir de nouveaux services très utiles. Cela faciliterait la traduction, les dépistages médicaux, l'éducation ou les conseils agricoles. La fracture numérique ne va pas disparaître grâce à une puce. Mais la conception du matériel peut soit creuser les inégalités, soit les atténuer.

Pourtant, il ne faut pas idéaliser cette invention. Ces puces minuscules ont de vraies limites. Elles font généralement tourner des modèles plus petits. Elles peuvent exceller dans une tâche précise et échouer dans une autre. Leur mise à jour peut s'avérer difficile. La sécurité devient même plus critique lorsque l'intelligence est répartie sur des millions d'appareils. Une caméra intelligente ou un capteur médical mal protégé peut devenir une cible facile. Le monde a déjà vu ce que donnent des objets connectés mal sécurisés. En 2016, l'attaque du botnet Mirai a transformé des appareils vulnérables en outils pour paralyser internet. Les futurs appareils Edge devront donc intégrer des protections beaucoup plus fortes dès le départ.

Cela soulève de grandes questions pour les gouvernements et l'industrie. Les entreprises doivent concevoir ces systèmes avec des règles très claires. Elles doivent préciser ce qui reste en local, ce qui part sur internet, et pourquoi. Les législateurs doivent exiger plus de transparence avec un langage simple. Ils doivent aussi imposer des mises à jour de sécurité et une durée de vie minimale pour ces appareils. Les commandes publiques peuvent aussi aider. Les écoles, les hôpitaux et les agences de transport peuvent choisir des vendeurs respectueux de la vie privée. Ils peuvent privilégier l'efficacité plutôt que la dépendance totale au cloud. Les autorités de régulation ont aussi un rôle à jouer. Elles doivent s'assurer que ces appareils fonctionnent bien sur tous les réseaux et restent faciles à mettre à jour au fil du temps.

La leçon la plus importante est facile à rater face à tout le bruit autour de l'IA. La meilleure invention n'est pas toujours le modèle le plus lourd ou le lancement le plus médiatisé. Parfois, c'est un simple petit composant qui redistribue le pouvoir. Les puces IA minuscules ne remplaceront pas le cloud. Elles ne mettent pas fin au besoin de calculs à grande échelle. Mais elles offrent une voie différente. Elles pourraient rendre les services numériques beaucoup plus rapides, moins chers et plus respectueux de la vie privée pour les citoyens ordinaires. Dans la technologie, l'avenir semble souvent immense. Et puis, soudainement, il devient assez petit pour tenir dans notre main.