Cómo la inteligencia artificial está automatizando silenciosamente la desigualdad en la atención médica moderna

28 de marzo de 2026

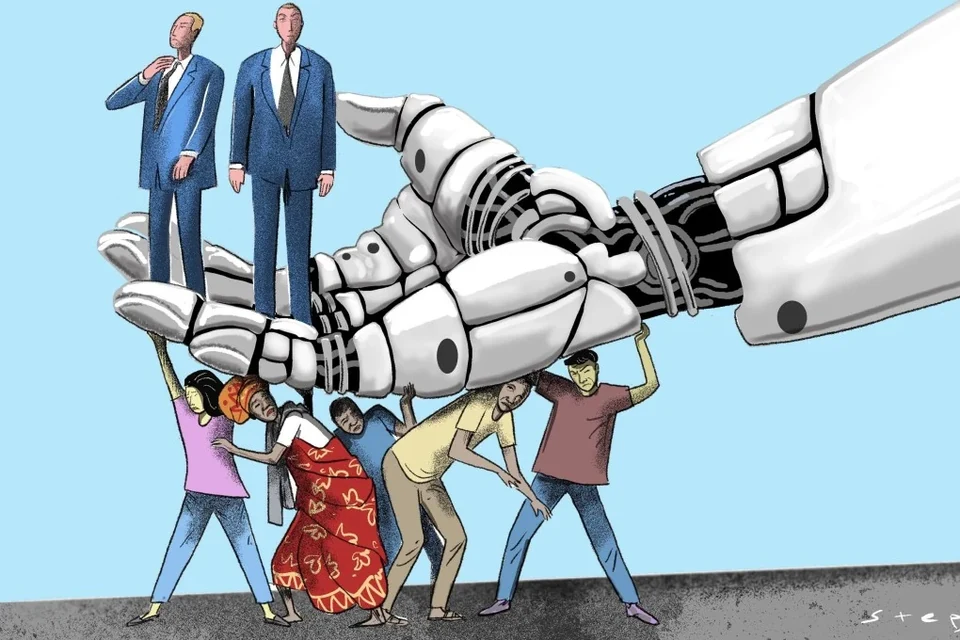

Existe la suposición generalizada de que la inteligencia artificial, construida sobre una base de matemáticas puras y código, es inherentemente objetiva. Cuando el juicio humano falla, nublado por el cansancio, los prejuicios subconscientes o los puntos ciegos emocionales, recurrimos cada vez más a la máquina como un árbitro neutral. Esto es especialmente cierto en el ámbito de alto riesgo de la atención médica, donde la promesa de los algoritmos de diagnóstico a menudo se presenta como un triunfo de la ciencia pura e imparcial sobre la defectuosa intuición humana. Sin embargo, a medida que los sistemas médicos de todo el mundo integran rápidamente el aprendizaje automático en la atención diaria de los pacientes, emerge una realidad profundamente preocupante. En lugar de borrar los prejuicios humanos, la inteligencia artificial a menudo los está absorbiendo, automatizando y amplificando, transformando las desigualdades históricas en reglas invisibles e institucionalizadas.

La idea de que una computadora no puede tener prejuicios se desmorona por completo al examinar cómo se construyen y despliegan realmente estos sistemas. Una investigación histórica publicada en la revista Science en 2019 reveló los profundos peligros de la toma de decisiones algorítmica sin supervisión. Los investigadores analizaron un algoritmo comercial de predicción de riesgos, ampliamente utilizado en el sistema de salud de los Estados Unidos para identificar a los pacientes que se beneficiarían de programas de gestión de atención de alto riesgo. Los datos mostraron que el algoritmo discriminaba sistemáticamente a los pacientes negros a gran escala. Para un paciente negro y uno blanco a los que el algoritmo les asignaba exactamente el mismo nivel de riesgo de salud, el paciente negro estaba, en realidad, significativamente más enfermo. Debido a esta puntuación matemáticamente defectuosa, millones de pacientes de minorías fueron funcionalmente empujados al final de la fila para recibir atención especializada, privados de intervenciones que podrían haber prolongado o salvado sus vidas.

Este no fue un fallo tecnológico aislado, sino más bien el síntoma de un problema sistémico mucho más amplio en la medicina digital. En el campo de la dermatología, las herramientas de diagnóstico por inteligencia artificial diseñadas para detectar cánceres de piel han sido entrenadas históricamente con conjuntos de datos compuestos abrumadoramente por imágenes de tonos de piel más claros. En consecuencia, cuando estas herramientas de diagnóstico se implementan en diversas clínicas del mundo real, su precisión se desploma en pacientes con piel más oscura. Una revisión importante de los conjuntos de datos de imágenes dermatológicas de código abierto utilizados para entrenar modelos de aprendizaje automático descubrió que solo una fracción microscópica de las imágenes representaba a poblaciones de ascendencia africana, del sur de Asia o hispana. La máquina es tan conocedora como el mundo que se le muestra, y cuando se deja a grupos demográficos enteros fuera de los materiales de entrenamiento fundamentales, inevitablemente quedan excluidos de los beneficios que salvan vidas de esta tecnología.

La causa subyacente de esta discriminación digital rara vez proviene de una malicia deliberada por parte de los ingenieros de software, sino más bien de un malentendido fundamental de los datos históricos. Los algoritmos aprenden a hacer predicciones analizando grandes cantidades de información pasada, buscando constantemente patrones para replicar. En el caso del algoritmo sesgado de gestión de la atención médica, los desarrolladores optaron por utilizar los costos históricos de atención médica como un indicador indirecto de las necesidades de salud. La suposición era simple y aparentemente lógica: los pacientes que requieren el mayor gasto médico probablemente son los más enfermos y los que necesitan más ayuda. Sin embargo, esta suposición ignoró la realidad socioeconómica de que las comunidades marginadas han enfrentado históricamente barreras significativas para acceder a la atención médica, que van desde la falta de un seguro confiable hasta vivir en desiertos médicos geográficos. Dado que los pacientes negros históricamente gastaban menos en atención médica debido a estas barreras sistémicas, el algoritmo concluyó erróneamente que eran intrínsecamente más saludables y requerían menos intervención futura. La inteligencia artificial no entendía de contexto, racismo o historia; solo entendía los números defectuosos que se le proporcionaban.

Las consecuencias de no abordar agresivamente el sesgo algorítmico son graves y de gran alcance. Cuando los modelos predictivos sesgados se integran sin problemas en los sistemas de clasificación (triaje) de los hospitales, los registros de trasplantes de riñón o el monitoreo de la salud materna, el daño no se mide en la pérdida de ingresos corporativos, sino en la morbilidad y mortalidad humanas. Esto crea una forma silenciosa y automatizada de marginación médica, donde a las poblaciones vulnerables se les niegan rutinariamente tratamientos proactivos o diagnósticos oportunos. Además, esta dinámica amenaza con erosionar por completo la confianza fundamental entre los pacientes y las instituciones médicas. Si las comunidades reconocen que las herramientas futuristas promocionadas para mejorar su atención son en realidad estructuralmente ciegas a su sufrimiento, las iniciativas de salud pública se enfrentarán a muros insuperables de escepticismo y rechazo. La automatización del prejuicio esencialmente perpetúa las disparidades históricas en la salud, dándoles una apariencia de inevitabilidad matemática que hace que sea increíblemente difícil para los médicos y los defensores de los pacientes poder cuestionarlas.

Rectificar esta crisis requiere un cambio fundamental en cómo los sectores médico y tecnológico conceptualizan, construyen e implementan las herramientas algorítmicas. La solución no es simplemente abandonar la inteligencia artificial en la atención médica, ya que su potencial para detectar tumores en etapas tempranas o predecir eventos cardíacos repentinos sigue siendo genuinamente revolucionario. En cambio, la industria debe adoptar marcos de trabajo rigurosos y estandarizados para la auditoría algorítmica y el diseño inclusivo. La Organización Mundial de la Salud ya ha emitido directrices estrictas sobre la ética de la inteligencia artificial en la salud, enfatizando la necesidad absoluta de contar con conjuntos de datos diversos y representativos. Los organismos reguladores deben exigir a las empresas de tecnología que demuestren que sus modelos funcionan igual de bien en diferentes grupos demográficos antes de permitir que esas herramientas interactúen con pacientes reales. Además, los equipos que diseñan estos algoritmos ya no pueden estar compuestos únicamente por informáticos e ingenieros de datos. Deben incluir expertos en ética médica, sociólogos y defensores de la salud comunitaria que posean el contexto histórico y cultural necesario para detectar las variables indirectas que conducen a la discriminación.

La inteligencia artificial no es un intelecto mágico e independiente; es un espejo profundo que refleja exactamente a la sociedad que la creó. Cuando apuntamos ese espejo hacia nuestros sistemas médicos, nos vemos obligados a confrontar las disparidades incómodas y profundamente arraigadas que, hasta ahora, no hemos logrado resolver. Sanar los sesgos inherentes dentro del código algorítmico está, en última instancia, entrelazado con el proyecto mucho más grande de sanar las inequidades en la sociedad humana. Si continuamos implementando rápidamente algoritmos ciegos entrenados en un pasado roto, simplemente automatizaremos la desigualdad para el futuro. Pero si exigimos transparencia institucional, insistimos en una representación diversa y priorizamos el contexto humano sobre la pura eficiencia matemática, podemos asegurar que la próxima era de la medicina digital sirva genuinamente a la salud y la dignidad de cada paciente, independientemente de su origen.