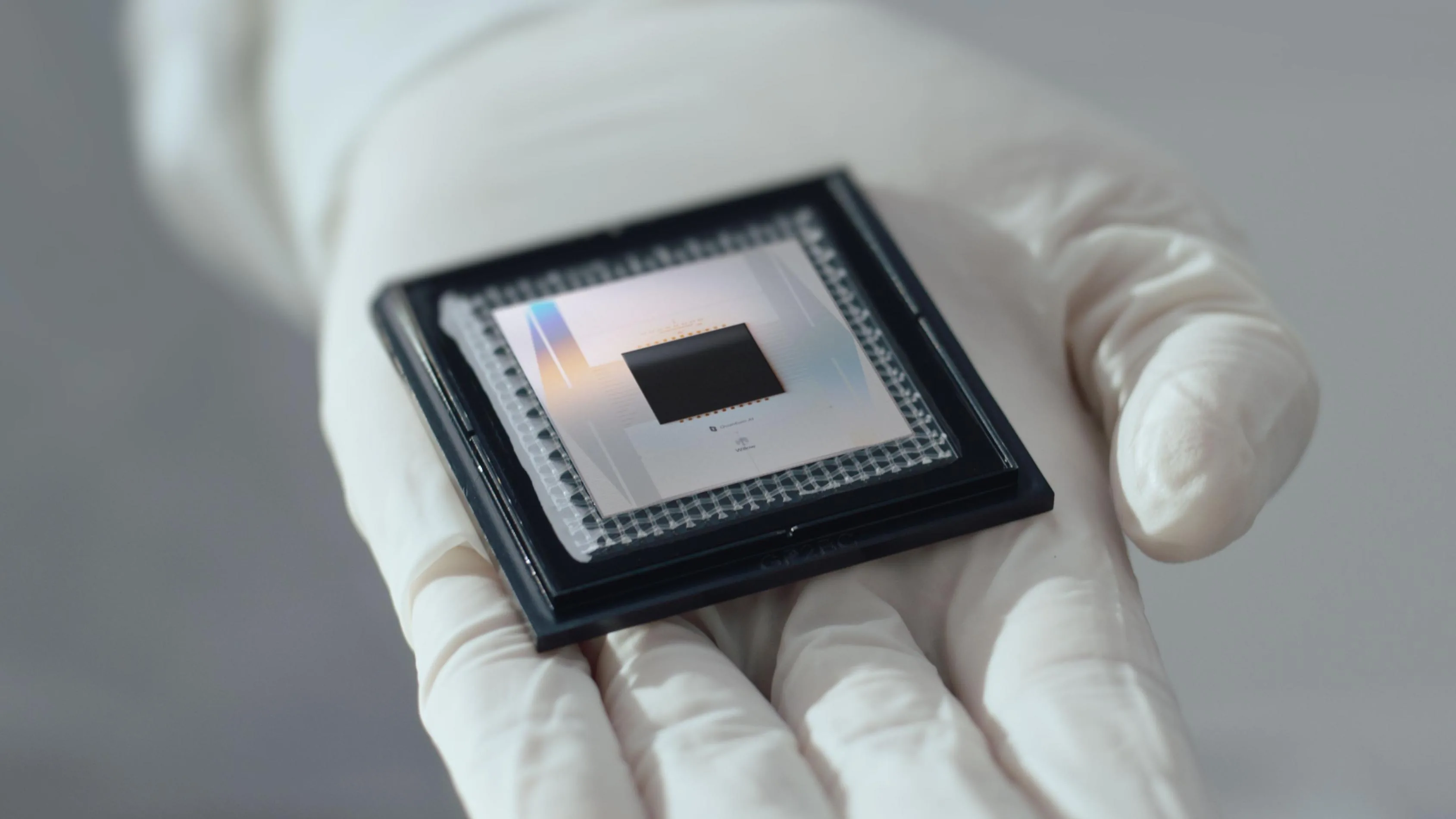

El diminuto chip que podría cambiar quién tiene acceso a la IA

1 de abril de 2026

Mucha gente sigue imaginando la inteligencia artificial como algo que vive en gigantescos centros de datos. Piensan en sistemas que consumen mucha electricidad y están controlados por unas pocas empresas enormes. Esa imagen todavía es en parte cierta. Entrenar los modelos más grandes exige un inmenso poder de procesamiento. Sin embargo, un nuevo invento está empezando a desafiar esa idea. Se trata de diminutos chips de "edge AI". Están diseñados para hacer tareas avanzadas de aprendizaje automático directamente en dispositivos pequeños. Este cambio parece muy técnico. Pero en la práctica, podría cambiar quién tiene acceso a la computación avanzada. También afectará hacia dónde van nuestros datos y qué partes de nuestra vida diaria dependerán menos de la nube.

La razón principal de este cambio es muy simple. Enviar datos de ida y vuelta a servidores lejanos suele ser lento y caro. Además, consume mucha energía. Esto también puede crear riesgos para la privacidad. Todo esto importa porque gran parte de la vida moderna depende de dispositivos conectados. Los teléfonos escuchan nuestros comandos de voz. Los autos vigilan los caminos y a los peatones. Los sensores en las fábricas buscan fallas. Los equipos médicos monitorean el habla, el movimiento y el ritmo cardíaco. Cuando cada acción depende de un servidor remoto, una mala conexión a internet se convierte en un obstáculo. Los costos suben. Y las demoras también.

Por eso, los fabricantes de chips y dispositivos llevan años compitiendo en una carrera tecnológica. Quieren llevar el procesamiento de datos directamente al aparato. Esto ya no es un experimento raro. Apple ha integrado motores neuronales en sus teléfonos y computadoras. Qualcomm vende chips listos para la IA en dispositivos móviles. Nvidia, Arm e Intel también compiten en distintas partes de este mercado de computación local. Algunas startups están yendo más lejos. Diseñan chips muy especializados para tareas de IA concretas. Estos usan solo una fracción de la energía que necesitan los procesadores normales. Los analistas de Gartner llevan años señalando la "edge AI" como una gran tendencia. Además, los pronósticos de empresas como IDC anticipan un rápido crecimiento en estas inversiones. Las compañías simplemente quieren procesar los datos más cerca de donde se crean.

La gran novedad no es solo que los chips sean más rápidos. El punto clave es que son más eficientes en formatos increíblemente pequeños. Varios investigadores han desarrollado diseños informáticos neuromórficos y "en memoria". Esto reduce la necesidad de mover datos entre la memoria y el procesador, algo que consume muchísima energía. IBM, Intel y varias startups han publicado resultados prometedores. Demuestran que estos diseños inspirados en el cerebro pueden reducir drásticamente el consumo eléctrico. Esto sirve para tareas como reconocer patrones o analizar sensores. Este campo aún es joven. Muchos prototipos no están listos para usarse a gran escala. Sin embargo, el camino está claro. La inteligencia artificial útil ya no significa tener una máquina caliente y costosa conectada a una enorme granja de servidores.

El motivo de fondo es un límite físico en la economía de la computación. Durante años, la industria mejoró sus sistemas haciendo chips más pequeños y metiendo más transistores. Eso sigue pasando. Pero esas mejoras ahora son más difíciles y caras de lograr. Al mismo tiempo, la carga de trabajo de la IA ha explotado. La Agencia Internacional de la Energía ya advirtió sobre este problema. Los centros de datos enfocados en IA consumen enormes cantidades de electricidad. La solución no siempre es construir centros cada vez más grandes. Muchas veces, lo más inteligente es evitar enviar tantos datos desde el principio. Un reloj inteligente puede detectar una caída. Un sensor agrícola puede identificar si un cultivo sufre estrés. Un audífono puede aclarar la voz en tiempo real sin conexión a internet. En todos estos casos, procesar los datos localmente es más que una comodidad. Se vuelve una necesidad de diseño.

Ya podemos ver cómo esto cambia la vida real. En el área médica, se han probado herramientas de IA locales que detectan señales cardíacas irregulares. También pueden monitorear la respiración sin enviar datos crudos a un servidor. Esto es clave en zonas rurales donde el internet falla. El gobierno de Estados Unidos ha mostrado repetidamente las brechas en el acceso a internet de alta velocidad en regiones apartadas. En las fábricas, los sistemas de IA local inspeccionan piezas en milisegundos. Esto reduce el desperdicio y los tiempos de inactividad. En los vehículos, la velocidad no es opcional. Un auto no puede esperar a que un servidor lejano decida algo crítico. Debe saber al instante si un objeto en la calle es un niño, una bicicleta o una bolsa de plástico.

El tema de la privacidad es igual de importante. Muchos usuarios se sienten incómodos con dispositivos que suben audios, videos o datos médicos a internet. Los robos de datos justifican ese miedo. IBM publica reportes anuales sobre el tema. Siempre encuentran que estos ataques cuestan mucho a las empresas y perjudican a las personas. Si el análisis de datos ocurre en el propio teléfono, sale menos información sensible a la web. Eso no resuelve todos los problemas de privacidad por sí solo. Un mal software o una seguridad débil aún pueden exponer a los usuarios. Pero procesar los datos de forma local ayuda mucho. Reduce la cantidad de información personal que circula por los sistemas corporativos.

Esto también afecta el acceso global a la tecnología. La IA en la nube necesita una buena infraestructura, grandes servidores y sistemas de pago seguros. Ese modelo suele favorecer a las empresas ricas y a los países desarrollados. Los chips de IA más pequeños y baratos podrían cambiar la historia. En partes de América Latina, India y África, mucha gente usa teléfonos móviles, pero el internet fijo es caro o limitado. Una IA local en teléfonos económicos podría ampliar el acceso a herramientas útiles. Esto incluye traductores, exámenes de salud, educación y consejos agrícolas. La brecha digital no desaparecerá solo con un nuevo chip. Pero el diseño del hardware puede aumentar la desigualdad o ayudar a reducirla.

Aun así, no hay que idealizar este invento. Los chips diminutos de IA tienen límites reales. Suelen ejecutar modelos más pequeños. Pueden ser excelentes en una tarea y muy malos en otra. Actualizarlos puede ser difícil. Además, la seguridad se vuelve mucho más importante y compleja. Es un gran reto proteger la inteligencia repartida en millones de aparatos. Una cámara inteligente o un sensor médico mal protegido puede convertirse en un blanco de ataques. El mundo ya ha visto el peligro del hardware inseguro. El ataque de la botnet Mirai en 2016 usó dispositivos vulnerables para causar un caos enorme en internet. Los nuevos equipos de edge AI necesitarán defensas mucho más fuertes desde el principio.

Esto nos lleva a las futuras decisiones de la industria y el gobierno. Las empresas deben crear sistemas con reglas claras. Deben explicar qué datos se quedan en el aparato, cuáles se suben a la red y por qué. Las autoridades deberían exigir políticas de privacidad más fáciles de leer. También deben pedir actualizaciones de seguridad obligatorias y un tiempo mínimo de soporte. Las compras públicas pueden ayudar. Las escuelas, hospitales y agencias de transporte pueden elegir proveedores que prioricen la privacidad. Deberían evitar los sistemas que dependen todo el tiempo de la nube. Los reguladores de telecomunicaciones también tienen una tarea clave. Deben asegurar que estos aparatos funcionen bien en diferentes redes y reciban actualizaciones de seguridad con el tiempo.

Es fácil perder de vista la gran lección entre todo el ruido que rodea a la IA. El invento más importante no siempre tiene el modelo más grande o el lanzamiento más espectacular. A veces, es una pieza de hardware más discreta que distribuye el poder hacia las personas. Los chips diminutos de IA no van a reemplazar a la nube. Tampoco acabarán con la necesidad de computación a gran escala. Sin embargo, ofrecen un camino distinto. Pueden hacer que los servicios digitales avanzados sean más rápidos, baratos y privados para la gente común. En la tecnología, el futuro suele parecer inmenso. Hasta que, de repente, se vuelve lo bastante pequeño como para caber en tu mano.