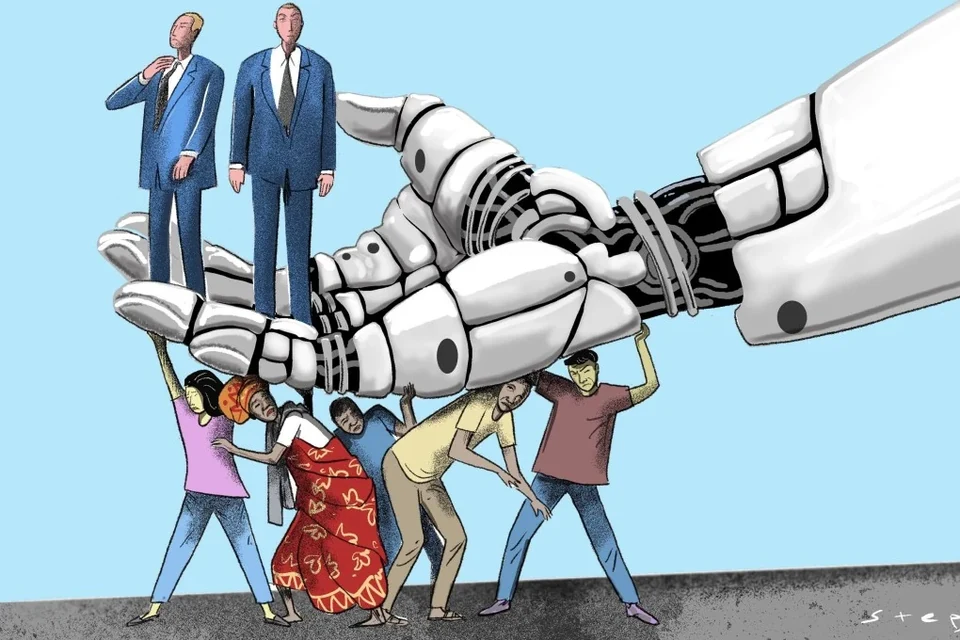

كيف يكرس الذكاء الاصطناعي بهدوء عدم المساواة في الرعاية الصحية الحديثة

٢٨ مارس ٢٠٢٦

هناك افتراض سائد بأن الذكاء الاصطناعي، المبني على أساس من الرياضيات والرموز البرمجية المجردة، يتسم بالموضوعية بطبيعته. وعندما يتعثر الحكم البشري، متأثراً بالإرهاق أو التحيز اللاواعي أو النقاط العمياء العاطفية، فإننا نلجأ بشكل متزايد إلى الآلة باعتبارها حكماً محايداً. وينطبق هذا بشكل خاص في مجال الرعاية الصحية بالغ الأهمية، حيث تُصاغ الوعود المتعلقة بالخوارزميات التشخيصية غالباً باعتبارها انتصاراً للعلم الخالص وغير المتحيز على الحدس البشري المعرض للخطأ. ومع ذلك، ومع مسارعة الأنظمة الطبية حول العالم لدمج التعلم الآلي في الرعاية اليومية للمرضى، تبرز حقيقة مقلقة للغاية. فبدلاً من محو التحيز البشري، غالباً ما يستوعبه الذكاء الاصطناعي ويقوم بأتمتته وتضخيمه، ليحول أوجه عدم المساواة التاريخية إلى قواعد مؤسسية غير مرئية.

وتنهار تماماً فكرة أن جهاز الكمبيوتر لا يمكن أن يكون متحيزاً عند فحص كيفية بناء هذه الأنظمة ونشرها على أرض الواقع. فقد كشف تحقيق بارز نُشر في مجلة "ساينس" (Science) عام 2019 عن المخاطر العميقة المترتبة على اتخاذ القرارات الخوارزمية دون رقابة. حيث دقق الباحثون في خوارزمية تجارية للتنبؤ بالمخاطر تُستخدم على نطاق واسع في نظام الرعاية الصحية بالولايات المتحدة لتحديد المرضى الذين يمكنهم الاستفادة من برامج إدارة الرعاية العالية المخاطر. وأظهرت البيانات أن الخوارزمية كانت تمارس تمييزاً منهجياً ضد المرضى السود على نطاق واسع. فبالنسبة لمريض أسود ومريض أبيض حددت الخوارزمية أن لديهما نفس المستوى الدقيق من المخاطر الصحية، كان المريض الأسود في الواقع أكثر مرضاً بشكل ملحوظ. وبسبب هذا التقييم المعيب رياضياً، تراجع ملايين المرضى من الأقليات فعلياً إلى الوراء في طابور الحصول على الرعاية المتخصصة، ليُحرموا من تدخلات طبية كان من الممكن أن تطيل أعمارهم أو تنقذ حياتهم.

لم يكن هذا مجرد خلل تقني عابر، بل كان عَرَضاً لمشكلة منهجية أوسع نطاقاً في الطب الرقمي. ففي مجال طب الجلدية، تم تدريب أدوات الذكاء الاصطناعي التشخيصية المصممة للكشف عن سرطانات الجلد تاريخياً على مجموعات بيانات تتكون في الغالبية العظمى منها من صور تظهر درجات بشرة فاتحة. ونتيجة لذلك، عندما يتم نشر هذه الأدوات التشخيصية في عيادات متنوعة على أرض الواقع، تتراجع دقتها بشكل حاد بالنسبة للمرضى ذوي البشرة الداكنة. وقد وجدت مراجعة كبرى لمجموعات بيانات صور الأمراض الجلدية المفتوحة المصدر المستخدمة لتدريب نماذج التعلم الآلي أن نسبة ضئيلة جداً من الصور تمثل سكاناً من أصول أفريقية أو جنوب آسيوية أو لاتينية. فالآلة لا تعرف سوى العالم الذي يُعرض عليها، وعندما يتم استبعاد فئات ديموغرافية بأكملها من مواد التدريب الأساسية، يتم استبعادها حتماً من الفوائد المنقذة للحياة التي تقدمها هذه التكنولوجيا.

ونادراً ما ينبع السبب الكامن وراء هذا التمييز الرقمي من سوء نية متعمد من جانب مهندسي البرمجيات، بل ينبع من سوء فهم أساسي للبيانات التاريخية. حيث تتعلم الخوارزميات إجراء التنبؤات من خلال تحليل كميات هائلة من المعلومات السابقة، والبحث باستمرار عن الأنماط لتكرارها. وفي حالة خوارزمية إدارة الرعاية المتحيزة، اختار المطورون استخدام تكاليف الرعاية الصحية التاريخية كمؤشر بديل للاحتياجات الصحية. كان الافتراض بسيطاً ومنطقياً في ظاهره؛ فالمرضى الذين يحتاجون إلى أكبر قدر من الإنفاق الطبي هم على الأرجح الأكثر مرضاً والأكثر حاجة إلى المساعدة. ومع ذلك، تجاهل هذا الافتراض الواقع الاجتماعي والاقتصادي المتمثل في أن المجتمعات المهمشة واجهت تاريخياً حواجز كبيرة تحول دون الحصول على الرعاية الطبية، بدءاً من الافتقار إلى التأمين الموثوق وصولاً إلى العيش في مناطق جغرافية تفتقر للخدمات الطبية. ولأن المرضى السود أنفقوا تاريخياً أقل على الرعاية الصحية بسبب هذه الحواجز المنهجية، استنتجت الخوارزمية بشكل خاطئ أنهم بطبيعتهم أكثر صحة ويحتاجون إلى تدخلات مستقبلية أقل. لم يفهم الذكاء الاصطناعي السياق أو العنصرية أو التاريخ؛ بل فهم فقط الأرقام المعيبة التي تم تغذيته بها.

إن عواقب الفشل في معالجة التحيز الخوارزمي بقوة تعتبر وخيمة وبعيدة المدى. فعندما يتم دمج النماذج التنبؤية المتحيزة بسلاسة في أنظمة فرز المرضى بالمستشفيات، أو سجلات زراعة الكلى، أو مراقبة صحة الأمهات، فإن الضرر لا يُقاس بخسارة إيرادات الشركات، بل بمعدلات المرض والوفيات بين البشر. يخلق هذا الأمر شكلاً صامتاً وآلياً من أشكال "الإقصاء الطبي" حيث تُحرم الفئات الضعيفة بشكل روتيني من العلاجات الاستباقية أو التشخيص الدقيق في الوقت المناسب. علاوة على ذلك، تهدد هذه الديناميكية بتقويض الثقة الأساسية بين المرضى والمؤسسات الطبية تماماً. فإذا أدركت المجتمعات أن الأدوات المستقبلية التي يُروج لها لتحسين رعايتها هي في الواقع عمياء بنيوياً عن معاناتها، فإن مبادرات الصحة العامة ستواجه جدراناً يستحيل تجاوزها من الشك والرفض. تؤدي أتمتة التحيز في جوهرها إلى ترسيخ التفاوتات الصحية التاريخية في مكانها، وتمنحها غطاءً من الحتمية الرياضية التي تجعل من الصعب للغاية على الأطباء الأفراد والمدافعين عن حقوق المرضى تحديها.

يتطلب تصحيح هذه الأزمة تحولاً جذرياً في كيفية تصور وبناء ونشر الأدوات الخوارزمية من قبل كل من قطاعي الطب والتكنولوجيا. فالحل لا يكمن ببساطة في التخلي عن الذكاء الاصطناعي في الرعاية الصحية، حيث تظل إمكاناته في اكتشاف الأورام في مراحلها المبكرة أو التنبؤ بأمراض القلب المفاجئة ثورية حقاً. وبدلاً من ذلك، يجب على القطاع اعتماد أطر عمل صارمة وموحدة لمراجعة الخوارزميات والتصميم الشامل. وقد أصدرت منظمة الصحة العالمية بالفعل مبادئ توجيهية صارمة بشأن أخلاقيات الذكاء الاصطناعي في مجال الصحة، مشددة على الضرورة المطلقة لوجود مجموعات بيانات متنوعة وتمثيلية. ويجب على الهيئات التنظيمية إلزام شركات التكنولوجيا بإثبات أن نماذجها تعمل بنفس الكفاءة عبر مختلف المجموعات الديموغرافية قبل السماح لهذه الأدوات على الإطلاق بالتفاعل مع مرضى حقيقيين. بالإضافة إلى ذلك، لم يعد من الممكن أن تتألف الفِرَق التي تصمم هذه الخوارزميات فقط من علماء الكمبيوتر ومهندسي البيانات؛ بل يجب أن تضم علماء أخلاقيات الطب، وعلماء الاجتماع، والمدافعين عن صحة المجتمع الذين يمتلكون السياق التاريخي والثقافي اللازم لاكتشاف المتغيرات البديلة التي تؤدي إلى التمييز.

الذكاء الاصطناعي ليس عقلاً سحرياً مستقلاً؛ بل هو مرآة عميقة تعكس بدقة المجتمع الذي صنعه. وعندما نوجه هذه المرآة نحو أنظمتنا الطبية، نُجبر على مواجهة التفاوتات المزعجة والمتأصلة بعمق والتي فشلنا حتى الآن في حلها. إن معالجة التحيزات الكامنة داخل الشفرات الخوارزمية تتشابك في النهاية مع المشروع الأكبر بكثير والمتمثل في معالجة أوجه عدم المساواة في المجتمع البشري. وإذا استمررنا في النشر السريع للخوارزميات العمياء المدربة على ماضٍ معيب، فإننا بكل بساطة سنقوم بأتمتة عدم المساواة للمستقبل. ولكن إذا طالبنا بالشفافية المؤسسية، وأصررنا على التمثيل المتنوع، وأعطينا الأولوية للسياق البشري على الكفاءة الرياضية المجردة، فيمكننا ضمان أن العصر القادم من الطب الرقمي سيخدم حقاً صحة وكرامة كل مريض، بغض النظر عن خلفيته.