Yapay Zeka Modern Sağlık Hizmetlerinde Eşitsizliği Nasıl Sessizce Otomatikleştiriyor

28 Mart 2026

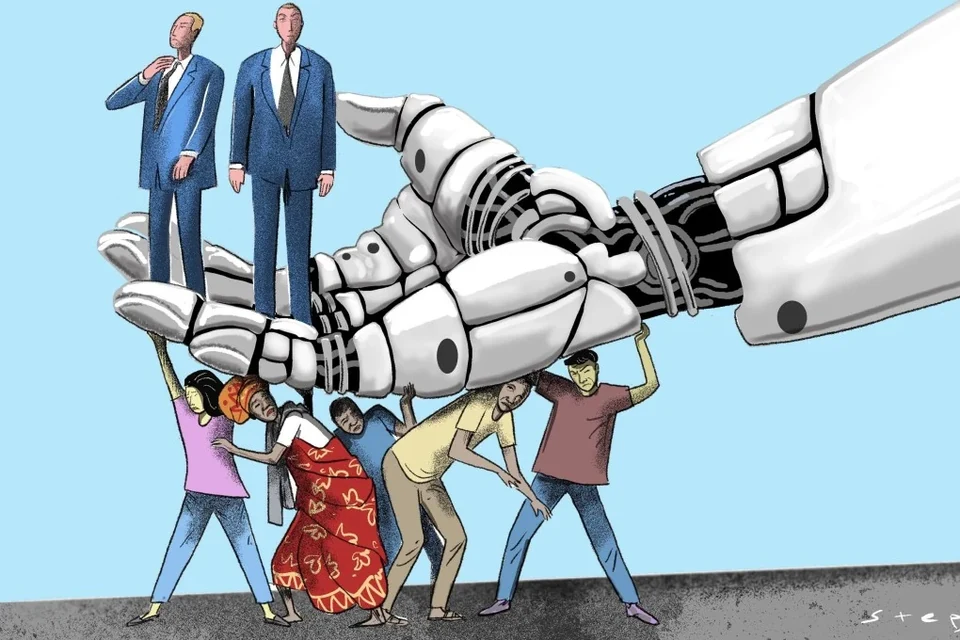

Saf matematik ve kod temeli üzerine kurulan yapay zekanın doğası gereği tarafsız olduğuna dair yaygın bir varsayım var. İnsan yargısı yorgunluk, bilinçaltı önyargılar veya duygusal kör noktalar nedeniyle gölgelenip zayıfladığında, tarafsız bir hakem olarak giderek daha fazla makinelere yöneliyoruz. Teşhis algoritmalarının sunduğu vaatlerin, genellikle kusurlu insan sezgisine karşı saf ve tarafsız bilimin bir zaferi olarak sunulduğu, hayati risklerin söz konusu olduğu sağlık alanında bu durum özellikle geçerli. Ancak, dünya çapındaki tıbbi sistemler makine öğrenimini günlük hasta bakımına hızla entegre ederken, son derece rahatsız edici bir gerçek ortaya çıkıyor. Yapay zeka, insani önyargıları ortadan kaldırmak yerine genellikle bunları özümsüyor, otomatikleştiriyor ve büyüterek tarihsel eşitsizlikleri görünmez, kurumsallaşmış kurallara dönüştürüyor.

Bir bilgisayarın önyargılı olamayacağı düşüncesi, bu sistemlerin gerçekte nasıl kurulup kullanıldığı incelendiğinde tamamen çöküyor. Science dergisinde 2019 yılında yayımlanan çığır açıcı bir araştırma, denetlenmeyen algoritmik karar alma süreçlerinin derin tehlikelerini gözler önüne serdi. Araştırmacılar, yüksek riskli bakım yönetimi programlarından faydalanabilecek hastaları belirlemek için ABD sağlık sistemi genelinde yaygın olarak kullanılan ticari bir risk tahmin algoritmasını incelediler. Veriler, algoritmanın siyahi hastalara karşı büyük çapta ve sistematik bir şekilde ayrımcılık yaptığını gösterdi. Algoritma tarafından sağlık riski seviyesi tamamen aynı olarak belirlenen siyahi bir hasta ile beyaz bir hasta karşılaştırıldığında, siyahi hastanın gerçekte çok daha hasta olduğu ortaya çıktı. Matematiksel olarak kusurlu olan bu puanlama yüzünden, azınlık gruplarına mensup milyonlarca hasta işlevsel olarak uzmanlaşmış bakım sırasında daha gerilere itildi ve hayatlarını uzatabilecek ya da kurtarabilecek müdahalelerden mahrum bırakıldı.

Bu, münferit bir teknolojik hata değil, dijital tıptaki çok daha geniş ve sistemik bir sorunun belirtisiydi. Dermatoloji alanında cilt kanserlerini tespit etmek için tasarlanan teşhis amaçlı yapay zeka araçları, geçmişten bu yana ezici bir çoğunlukla daha açık ten renklerini içeren veri setleriyle eğitildi. Sonuç olarak, bu teşhis araçları gerçek dünyadaki çeşitli kliniklerde kullanıldığında, daha koyu tenli hastalar için doğruluk oranları dibe vuruyor. Makine öğrenimi modellerini eğitmek için kullanılan açık kaynaklı dermatolojik görüntü veri setleri üzerinde yapılan büyük bir inceleme, görüntülerin yalnızca çok küçük bir bölümünün Afrika, Güney Asya veya Hispanik kökenli toplulukları temsil ettiğini buldu. Makine sadece kendisine gösterilen dünya kadar bilgi sahibidir ve temel eğitim materyallerinden koca bir demografik yapı çıkarıldığında, bu gruplar ister istemez teknolojinin hayat kurtaran faydalarından da mahrum kalırlar.

Bu dijital ayrımcılığın temel nedeni nadiren yazılım mühendislerinin kasıtlı kötülüğünden kaynaklanır; sorun daha çok geçmiş verilerin temelden yanlış anlaşılmasıdır. Algoritmalar, kopyalayacakları kalıpları sürekli arayarak büyük miktardaki geçmiş bilgiyi analiz edip tahminler yürütmeyi öğrenirler. Önyargılı bakım yönetimi algoritması örneğinde, geliştiriciler geçmiş sağlık harcamalarını sağlık ihtiyaçlarının bir göstergesi olarak kullanmayı tercih ettiler. Varsayım basit ve görünüşte mantıklıydı: En çok tıbbi harcamaya ihtiyaç duyan hastalar muhtemelen en hasta olanlardır ve en çok yardıma onlar ihtiyaç duyar. Ancak bu varsayım, ötekileştirilmiş toplulukların geçmişte güvenilir sigorta eksikliğinden tıbbi hizmetten yoksun coğrafyalarda yaşamaya kadar, sağlık hizmetlerine erişimde ciddi engellerle karşılaştığı sosyoekonomik gerçeğini göz ardı ediyordu. Siyahi hastalar bu sistemik engeller nedeniyle geçmişte sağlık hizmetlerine daha az para harcadıkları için, algoritma onların doğaları gereği daha sağlıklı oldukları ve gelecekte daha az müdahaleye ihtiyaç duydukları gibi yanlış bir sonuca vardı. Yapay zeka bağlamı, ırkçılığı veya tarihi anlamadı; sadece kendisine verilen kusurlu sayıları anladı.

Algoritmik önyargıyla kararlı bir şekilde mücadele edilmemesinin sonuçları oldukça ağır ve geniş çaplıdır. Önyargılı tahmin modelleri hastane triyaj sistemlerine, böbrek nakli kayıtlarına veya anne sağlığı takibine sorunsuz bir şekilde entegre edildiğinde, ortaya çıkan zarar kaybedilen şirket gelirleriyle değil, insanlardaki hastalık ve ölüm oranlarıyla ölçülür. Bu durum, savunmasız grupların rutin olarak proaktif tedavilerden veya doğru zamanlanmış teşhislerden mahrum bırakıldığı sessiz ve otomatikleşmiş bir tıbbi ayrımcılık biçimi yaratır. Dahası bu dinamik, hastalar ile sağlık kurumları arasındaki temel güveni tamamen yok etme tehlikesi taşıyor. Toplumlar, bakımlarını iyileştireceği iddia edilen bu fütüristik araçların aslında kendi acılarına yapısal olarak kör olduğunu fark ederse, halk sağlığı girişimleri aşılamaz şüphecilik ve ret duvarlarıyla karşılaşacaktır. Önyargıların otomatikleşmesi aslında tarihsel sağlık eşitsizliklerini kalıcı hale getirir ve onlara matematiksel bir kaçınılmazlık kisvesi kazandırarak bireysel doktorların ve hasta savunucularının bunlara karşı çıkmasını inanılmaz derecede zorlaştırır.

Bu krizi düzeltmek, hem tıp hem de teknoloji sektörlerinin algoritmik araçları kavrama, inşa etme ve kullanma biçiminde köklü bir değişim gerektiriyor. Çözüm, sağlık hizmetlerinde yapay zekayı bir kenara bırakmak değildir; zira yapay zekanın erken evre tümörleri yakalama veya ani kalp krizlerini tahmin etme potansiyeli gerçekten de devrim niteliğini koruyor. Bunun yerine sektör, algoritmik denetim ve kapsayıcı tasarım için titiz, standartlaştırılmış çerçeveler benimsemelidir. Dünya Sağlık Örgütü, sağlıkta yapay zekanın etiği üzerine sıkı yönergeler yayımlayarak çeşitli ve kapsayıcı veri setlerinin mutlak gerekliliğini zaten vurguladı. Düzenleyici kurumlar, teknoloji şirketlerini araçları gerçek hastalarla temas etmeden önce modellerinin farklı demografik gruplarda eşit derecede iyi performans gösterdiğini kanıtlamakla zorunlu tutmalıdır. Ayrıca, bu algoritmaları tasarlayan ekipler artık sadece bilgisayar bilimcilerinden ve veri mühendislerinden oluşamaz. Bu ekiplere, ayrımcılığa yol açan dolaylı değişkenleri tespit etmek için gereken tarihsel ve kültürel bağlama sahip tıp etiği uzmanları, sosyologlar ve toplum sağlığı savunucuları da dahil edilmelidir.

Yapay zeka sihirli ve bağımsız bir zeka değildir; tam da onu yaratan toplumu yansıtan derin bir aynadır. Bu aynayı tıbbi sistemlerimize tuttuğumuzda, şimdiye kadar çözemediğimiz rahatsız edici ve köklü eşitsizliklerle yüzleşmek zorunda kalıyoruz. Algoritmik kodun içindeki kalıtsal önyargıları iyileştirmek, nihayetinde insan toplumundaki eşitsizlikleri iyileştirmeye yönelik çok daha büyük bir projeyle iç içedir. Kusurlu bir geçmişle eğitilmiş kör algoritmaları hızla kullanmaya devam edersek, gelecekte de eşitsizliği otomatikleştirmiş oluruz. Ancak kurumsal şeffaflık talep eder, çeşitli temsiller konusunda ısrarcı olur ve insan bağlamını saf matematiksel verimliliğin önünde tutarsak, dijital tıbbın bir sonraki döneminin geçmişi ne olursa olsun her hastanın sağlığına ve onuruna gerçekten hizmet etmesini sağlayabiliriz.