Yapay zeka istenmeyen fotoğraflara kalkan oldu: Artık görmeden engelliyor

31 Mart 2026

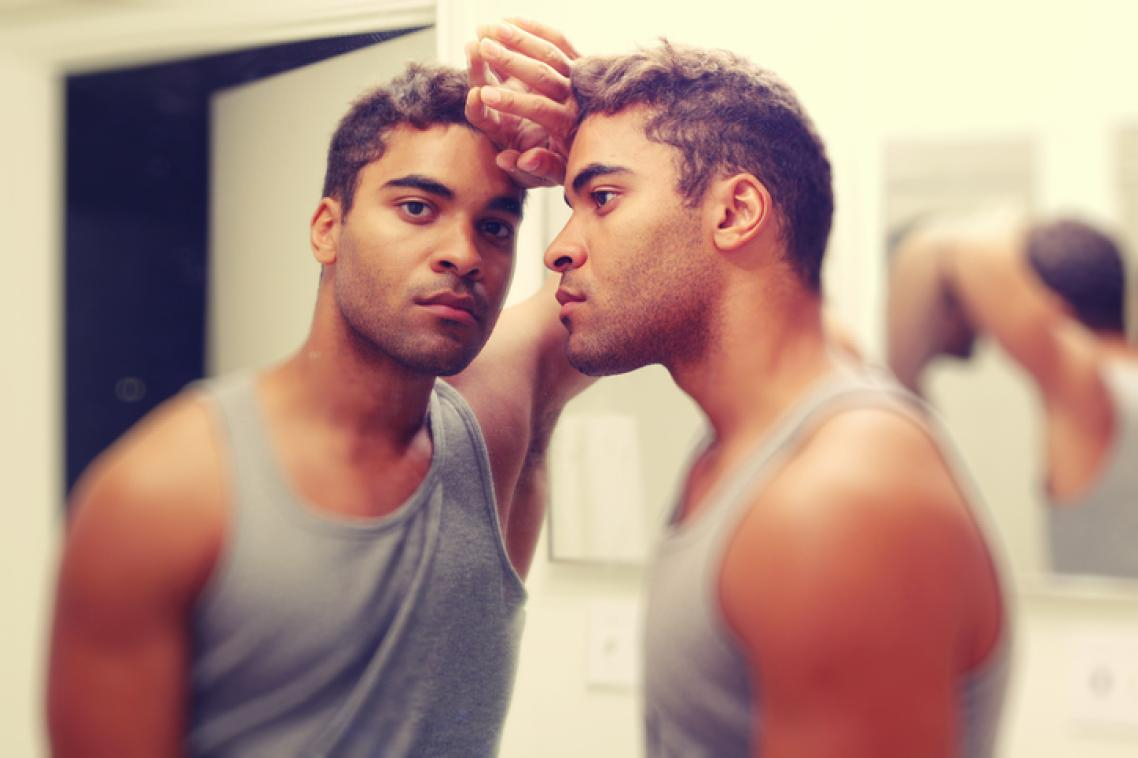

Çoğu insan, modern teknoloji şirketlerinin yasaklı içerikleri kullanıcı ekranına ulaşmadan anında filtreleyebildiğini varsayar. Yapay zekanın telif hakkı ihlallerini saniyeler içinde yakalamasına, nefret söylemini daha yazılırken tespit etmesine ve hatta tek bir metin komutuyla hiper-gerçekçi manzaralar üretmesine güveniriz. Ancak on yılı aşkın bir süredir, oldukça yaygın ve özel bir dijital taciz türü bu devasa algoritmik ağlardan sızmayı başardı. Genellikle dijital flört çağının tatsız ama kaçınılmaz bir şakası olarak görülen, istenmeden gönderilen erkek cinsel organı fotoğrafları, görüntü tanıma mühendisleri için şaşırtıcı derecede zor bir sorun yarattı. Bu müstehcen görüntüleri kullanıcı gizliliğini ihlal etmeden doğru bir şekilde tespit edip engelleyebilecek bir yazılım geliştirme mücadelesi, modern dijital altyapıyı nasıl tasarladığımızı yeniden şekillendiriyor.

Sorunun boyutu o kadar büyük ki, sadece davranışsal değil, teknolojik bir müdahale gerektiriyor. Pew Araştırma Merkezi'nin topladığı veriler, internette aktif olan genç kadınların neredeyse yarısının istemedikleri müstehcen bir görüntü aldığını sürekli olarak gösteriyor. Flört uygulamalarında, anonim mesajlaşma platformlarında ve sosyal medya direkt mesajlarında aniden beliren bu görüntüler, bir tür dijital teşhircilik işlevi görüyor. Platformlar yıllarca tamamen şikayete bağlı denetime güvendi. Kullanıcının mesajı açması, görüntünün şokunu yaşaması ve ardından insanlardan oluşan bir denetim ekibini uyarmak için bir şikayet menüsünde manuel olarak gezinmesi gerekiyordu. Bu eski sistem, tüm yaptırım yükünü mağdurun omuzlarına yüklüyor, yazılımın kendisi ise istismar için tamamen pasif bir aracı olarak kalıyordu.

Eski yazılımların bu sorunu çözmedeki başarısızlığı sonunda yasa yapıcıların dikkatini çekti ve sorun basit bir kullanıcı şikayeti olmaktan çıkıp sistemik bir yasal sorumluluğa dönüştü. Birleşik Krallık'ta yakın zamanda çıkarılan bir yasa, siber teşhirciliği resmen suç haline getirdi. Böylece, istenmeyen mahrem görüntü gönderenlere ceza getiren Kaliforniya ve Teksas gibi Amerika Birleşik Devletleri'ndeki giderek artan sayıda yargı bölgesine katıldı. Yasal riskler arttıkça, teknoloji şirketleri artık bu konuyu düşük öncelikli bir denetim sorunu olarak görme lüksüne sahip değildi. Önleyici mühendislik çözümlerine büyük yatırımlar yapmak zorunda kaldılar, ancak mevcut görüntü tanıma yazılımlarının ciddi teknik sınırlamalarıyla karşılaştılar.

Bu gecikmenin temel nedeni yalnızca şirketlerin kayıtsızlığı değil, aynı zamanda yapay zeka ve gizlilik mimarisindeki gerçek bir sınırlamaydı. Yüz tanıma teknolojisinin hakim olduğu bir dünyada bir makine öğrenmesi modelini belirli insan anatomisini tanıyacak şekilde eğitmek kulağa basit geliyor. Ancak insan vücudu bir bilgisayar için inanılmaz derecede karmaşık değişkenler sunar. İlk görüntü tanıma algoritmaları, masum fotoğrafları yanlışlıkla işaretleme sorunuyla (yanlış pozitif) boğuşup durdu. Işıklandırmadaki farklılıklar, çeşitli cilt tonları, yoğun gölgeler ve parmak, sosisli sandviç veya garip şekilli meyveler gibi tamamen masum nesneler, yazılımı sürekli olarak yanıltarak zararsız fotoğrafları işaretlemesine neden oldu. Mühendisler, çok agresif ayarlanmış bir algoritmanın gündelik sohbetleri sansürleyeceğini, çok gevşek ayarlanmış bir algoritmanın ise tacizin dokunulmadan geçip gitmesine izin vereceğini fark etti.

Bunun da ötesinde, teknoloji endüstrisi küresel kullanıcı gizliliğini korumak için uçtan uca şifrelemeye yöneldikçe, içerik denetçileri için büyük bir engel daha ortaya çıktı. Eğer bir platform, yasal veya teknik olarak direkt bir mesajın içeriğinin şifresini çözüp merkezi sunucularında inceleyemiyorsa, gönderim sırasında kötü niyetli görüntüleri taramak için bulut tabanlı bir algoritma kullanamaz. Bu durum dijital altyapı için bir çelişki yarattı. Kullanıcıları hükümet gözetiminden ve şirketlerin veri toplamasından korumak için tasarlanan şifreleme standartları, farkında olmadan kötü niyetli kişilerin istenmeyen mahrem görüntüleri fark edilmeden dağıtması için mükemmel derecede güvenli bir tünel sağlıyordu.

Bu görüntüleri filtrelemedeki teknolojik başarısızlığın dijital kamusal yaşam için ciddi sonuçları var. Çevrimiçi davranışlar üzerine yapılan araştırmalar, dijital cinsel tacize sıkça maruz kalmanın internete katılım üzerinde derin bir caydırıcı etki yarattığını defalarca göstermiştir. Kullanıcılar kendi direkt mesajlarında kendilerini temelden güvensiz hissettiklerini, bu durumun onları profillerini kilitlemeye, herkese açık tartışmaları terk etmeye veya belirli uygulamalardan tamamen ayrılmaya ittiğini bildiriyor. Bu dijital alışverişin zorluğu tamamen asimetrik. Bir fotoğrafı yükleyip göndermek saniyenin çok küçük bir kısmını alırken, yaşanan duygusal ihlali işlemek, göndereni engellemek ve kullanışsız bir şikayet arayüzünde gezinmek alıcıdan muazzam zaman ve enerji çalıyor. İnternetin mimarisi, tacizi gönderen için maliyetsiz, alıcı içinse yorucu hale getirerek adeta bu durumu destekliyordu.

Bu karmaşık bilmeceyi çözmek için mühendisler, görüntü denetiminin temel işleyişini yeniden düşünmek zorunda kaldılar. Şirketler, görüntüleri merkezi bir bulutta taramak yerine, tamamen bir akıllı telefonun yerel donanımında çalışabilen hafif yapay zeka modelleri geliştirmeye başladılar. Uç bilişim (edge computing) olarak bilinen bu konsept, analitik gücü elinizdeki cihaza indiriyor. Flört platformları, bu yerel tespitin ilk versiyonlarına öncülük etti. Bu platformlar, bir görüntünün ekranda tam olarak görünmeden önce erkek anatomisini yerel olarak tespit etmek için son derece özel veri setleri üzerinde eğitilmiş algoritmalar kullandılar.

Yerel yazılım, müstehcen içerik olasılığının yüksek olduğunu hesapladığında, fotoğrafı otomatik olarak bulanıklaştırır ve kullanıcıya bir uyarı gösterir. Bu, alıcıya görüntünün bulanıklaştırılmamış haline maruz kalmadan onu görme, şikayet etme veya silme gücü verir. Apple da yakın zamanda benzer bir isteğe bağlı güvenlik özelliğini doğrudan mobil işletim sistemine entegre etti. Görüntü analizi uzak bir sunucuda değil, tamamen cihazın kendi silikon çipi üzerinde gerçekleştiği için uçtan uca şifreleme mükemmel bir şekilde korunmuş olur. Platform fotoğrafı asla görmez, ancak kullanıcı yine de istismardan korunur.

Bu cihaz üzerinde çalışan bulanıklaştırma araçları, dijital altyapıyı nasıl inşa ettiğimiz ve kişisel güvenliğe nasıl öncelik verdiğimiz konusunda büyük bir felsefi değişimi temsil ediyor. Teknoloji endüstrisi uzun bir süre kullanıcı korumasını sonradan düşünülen bir mesele, psikolojik hasar verildikten sonra düşük ücretli insan denetçilerin dijital pisliği temizlemesiyle halledilecek bir sorun olarak gördü. Geliştiriciler, yapay zekayı doğrudan ağın ucuna taşıyarak, nihayet kullanıcıların kontrol edebileceği dijital sınırlar inşa ediyorlar. Bu özel taciz türünün gelişmesine olanak tanıyan sürtünmesiz ortamı başlangıçta teknoloji yaratmıştı, ancak şimdi daha akıllı ve gizliliğe saygılı algoritmalarla kapıyı kapatacak araçları yine teknoloji sağlıyor.