Como a Inteligência Artificial Está Silenciosamente Automatizando a Desigualdade na Saúde Moderna

28 de março de 2026

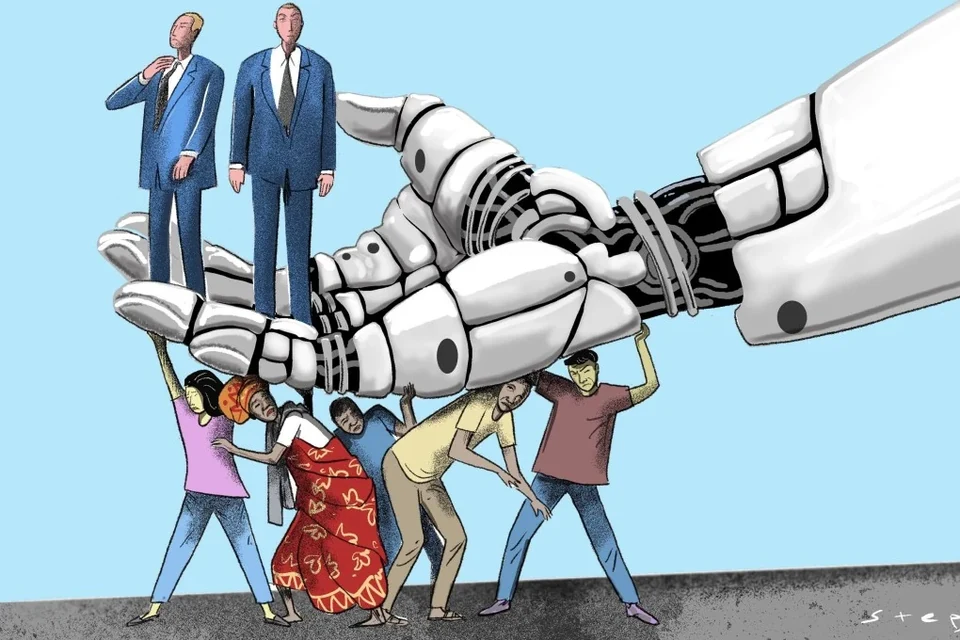

Existe uma suposição generalizada de que a inteligência artificial, construída sobre uma base de matemática pura e código, é inerentemente objetiva. Quando o julgamento humano falha, obscurecido pela exaustão, preconceitos subconscientes ou pontos cegos emocionais, cada vez mais recorremos à máquina como um árbitro neutro. Isso é especialmente verdadeiro na área crítica da saúde, onde a promessa dos algoritmos de diagnóstico é frequentemente apresentada como um triunfo da ciência pura e imparcial sobre a intuição humana falha. No entanto, à medida que os sistemas médicos em todo o mundo integram rapidamente o aprendizado de máquina no atendimento diário aos pacientes, uma realidade profundamente preocupante está surgindo. Em vez de apagar o preconceito humano, a inteligência artificial muitas vezes o absorve, automatiza e amplifica, transformando desigualdades históricas em regras invisíveis e institucionalizadas.

A noção de que um computador não pode ter preconceitos desmorona completamente ao examinar como esses sistemas são realmente construídos e implementados. Uma investigação marcante publicada na revista Science em 2019 revelou os perigos profundos das decisões algorítmicas sem supervisão. Os pesquisadores analisaram minuciosamente um algoritmo comercial de previsão de risco, amplamente utilizado em todo o sistema de saúde dos Estados Unidos, para identificar pacientes que se beneficiariam de programas de gestão de cuidados de alto risco. Os dados mostraram que o algoritmo discriminava sistematicamente pacientes negros em grande escala. Para um paciente negro e um paciente branco que o algoritmo determinou ter exatamente o mesmo nível de risco de saúde, o paciente negro estava, na realidade, significativamente mais doente. Devido a essa pontuação matematicamente falha, milhões de pacientes de minorias foram, na prática, empurrados para o final da fila de cuidados especializados, privados de intervenções que poderiam ter prolongado ou salvo suas vidas.

Esta não foi uma falha tecnológica isolada, mas sim o sintoma de um problema sistêmico muito mais amplo na medicina digital. No campo da dermatologia, ferramentas de diagnóstico por inteligência artificial desenvolvidas para detectar cânceres de pele foram historicamente treinadas em conjuntos de dados compostos esmagadoramente por imagens de tons de pele mais claros. Consequentemente, quando essas ferramentas de diagnóstico são utilizadas em clínicas diversas no mundo real, sua precisão despenca para pacientes com pele mais escura. Uma grande revisão de conjuntos de dados de imagens dermatológicas de código aberto utilizados para treinar modelos de aprendizado de máquina descobriu que apenas uma fração microscópica das imagens representava populações de ascendência africana, sul-asiática ou hispânica. A máquina é tão conhecedora quanto o mundo que lhe é mostrado, e quando parcelas demográficas inteiras são deixadas de fora dos materiais de treinamento fundamentais, elas inevitavelmente também ficam de fora dos benefícios salvadores da tecnologia.

A causa subjacente dessa discriminação digital raramente se origina de malícia deliberada por parte dos engenheiros de software, mas sim de uma interpretação equivocada e fundamental dos dados históricos. Os algoritmos aprendem a fazer previsões analisando grandes quantidades de informações passadas, constantemente buscando padrões para replicar. No caso do algoritmo tendencioso de gestão de cuidados, os desenvolvedores optaram por usar o histórico de custos de saúde como um indicador das necessidades de saúde. A suposição era simples e aparentemente lógica: os pacientes que exigem mais gastos médicos provavelmente são os mais doentes e precisam de mais ajuda. No entanto, essa suposição ignorou a realidade socioeconômica de que as comunidades marginalizadas enfrentam historicamente barreiras significativas no acesso a cuidados médicos, que vão desde a falta de um plano de saúde confiável até a vivência em desertos médicos geográficos. Como os pacientes negros historicamente gastavam menos com saúde devido a essas barreiras sistêmicas, o algoritmo concluiu erroneamente que eles eram inerentemente mais saudáveis e exigiam menos intervenções futuras. A inteligência artificial não entendeu o contexto, o racismo ou a história; ela apenas entendeu os números falhos que lhe foram fornecidos.

As consequências de não enfrentar agressivamente o viés algorítmico são graves e de longo alcance. Quando modelos preditivos tendenciosos são integrados de forma contínua em sistemas de triagem hospitalar, registros de transplantes renais ou monitoramento da saúde materna, o dano não é medido na perda de receita corporativa, mas na morbidade e mortalidade humanas. Isso cria uma forma silenciosa e automatizada de segregação médica, na qual populações vulneráveis têm negados rotineiramente tratamentos proativos ou diagnósticos no momento exato. Além disso, essa dinâmica ameaça corroer completamente a confiança fundamental entre pacientes e instituições médicas. Se as comunidades perceberem que as ferramentas futuristas promovidas para melhorar o seu atendimento são, na verdade, estruturalmente cegas ao seu sofrimento, as iniciativas de saúde pública enfrentarão muros intransponíveis de ceticismo e recusa. A automação do preconceito essencialmente fixa as disparidades históricas na saúde, dando-lhes uma aparência de inevitabilidade matemática que as torna incrivelmente difíceis de serem contestadas por médicos individuais e defensores dos pacientes.

Corrigir esta crise exige uma mudança fundamental na forma como os setores médico e de tecnologia conceituam, constroem e implementam ferramentas algorítmicas. A solução não é simplesmente abandonar a inteligência artificial na saúde, pois seu potencial para detectar tumores em estágio inicial ou prever eventos cardíacos súbitos continua sendo genuinamente revolucionário. Em vez disso, a indústria deve adotar estruturas rigorosas e padronizadas para auditoria algorítmica e design inclusivo. A Organização Mundial da Saúde já emitiu diretrizes rigorosas sobre a ética da inteligência artificial na saúde, enfatizando a necessidade absoluta de conjuntos de dados diversos e representativos. As empresas de tecnologia devem ser obrigadas por órgãos reguladores a provar que seus modelos funcionam igualmente bem em diferentes grupos demográficos antes que essas ferramentas tenham permissão para interagir com pacientes reais. Além disso, as equipes que projetam esses algoritmos não podem mais ser formadas exclusivamente por cientistas da computação e engenheiros de dados. Elas devem incluir especialistas em ética médica, sociólogos e defensores da saúde comunitária que possuam o contexto histórico e cultural necessário para identificar indicadores indiretos que levam à discriminação.

A inteligência artificial não é um intelecto mágico e independente; é um espelho profundo que reflete exatamente a sociedade que a criou. Quando apontamos esse espelho para nossos sistemas médicos, somos forçados a confrontar as disparidades desconfortáveis e profundamente enraizadas que até agora não conseguimos resolver. Curar os vieses inerentes ao código algorítmico está, em última análise, entrelaçado com o projeto muito maior de curar as desigualdades na sociedade humana. Se continuarmos a implementar rapidamente algoritmos cegos treinados em um passado falho, simplesmente automatizaremos a desigualdade para o futuro. Mas se exigirmos transparência institucional, insistirmos na representatividade diversa e priorizarmos o contexto humano em detrimento da pura eficiência matemática, poderemos garantir que a próxima era da medicina digital sirva genuinamente à saúde e à dignidade de todos os pacientes, independentemente de suas origens.